Eleven v3 Audio Tags: Wyrażanie emocji w mowie

- Kategoria

- Materiały

- Data

Jak budujemy systemy AI, które rozmawiają w czasie rzeczywistym – o decyzjach technicznych dotyczących przejmowania głosu, opóźnień i ekspresji oraz o modelach, które już udostępniliśmy.

Od lat pracujemy nad tą kategorią. W tym wpisie pokazujemy, co już wdrożyliśmy i jakie decyzje badawcze oraz produktowe za tym stoją.

Nasz flagowy produkt – ElevenAgents z v3 Conversational

Expressive Mode – Mark – Połączenie o pożyczkę (panika) – materiał startowy.mp4

Trzy rzeczy muszą się zgrać, żeby system interakcji działał dobrze i dawał naturalne, angażujące rozmowy:

*Dotyczy tylko czasu działania modelu. Faktyczne opóźnienie zależy m.in. od twojej lokalizacji i wybranego endpointu.

Co już wdrożyliśmy

Spekulatywne przejmowanie głosu. Osobna funkcja w v3 Conversational, która uruchamia generowanie odpowiedzi LLM podczas ciszy użytkownika, skracając odczuwalne opóźnienie.

Flash v2.5. Nasz najszybszy model Text to Speech, stworzony do pracy w czasie rzeczywistym, działa w ok. 75 ms.*

Scribe v2. Nasz model Speech to Text z najlepszą dokładnością na rynku.

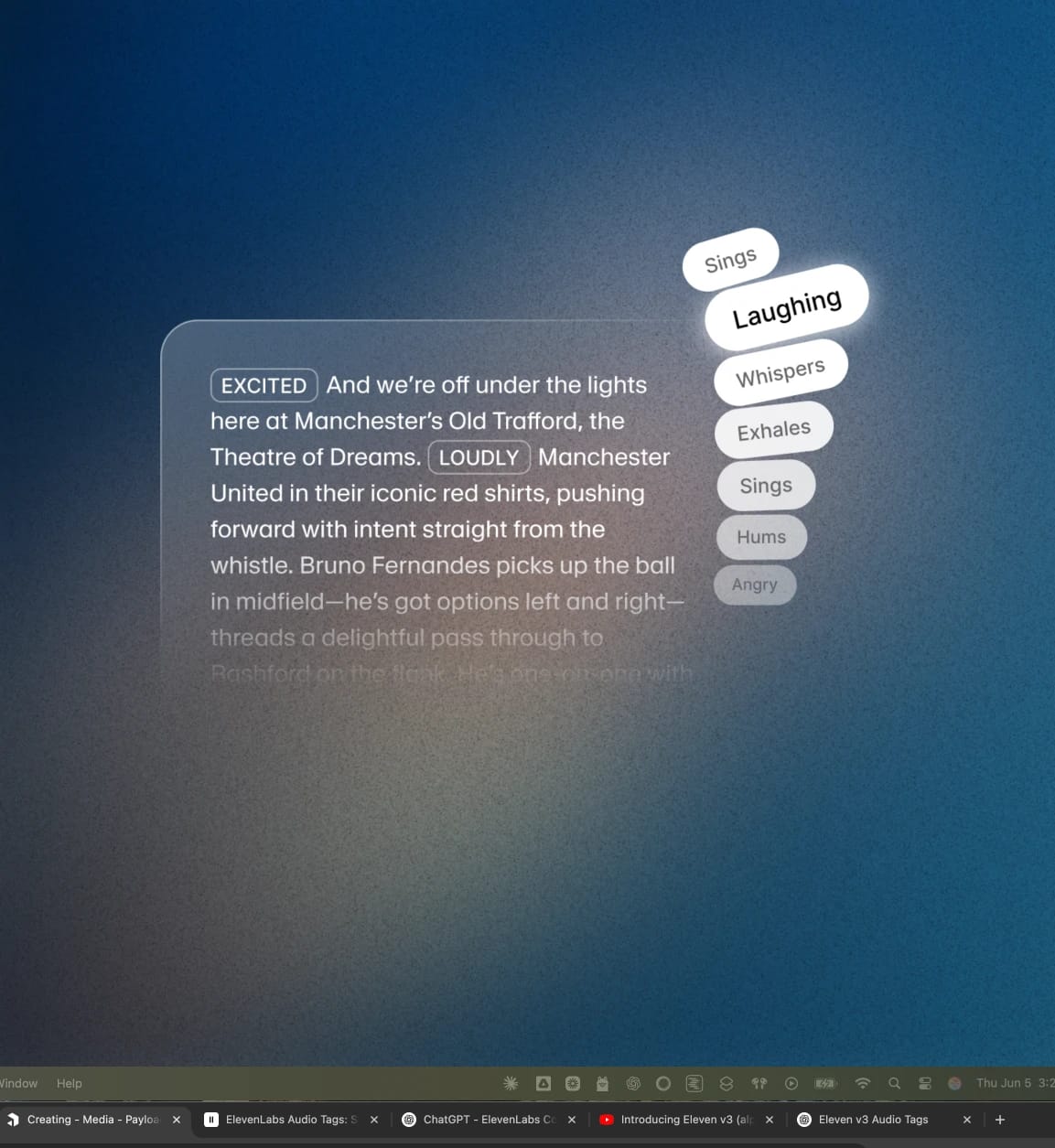

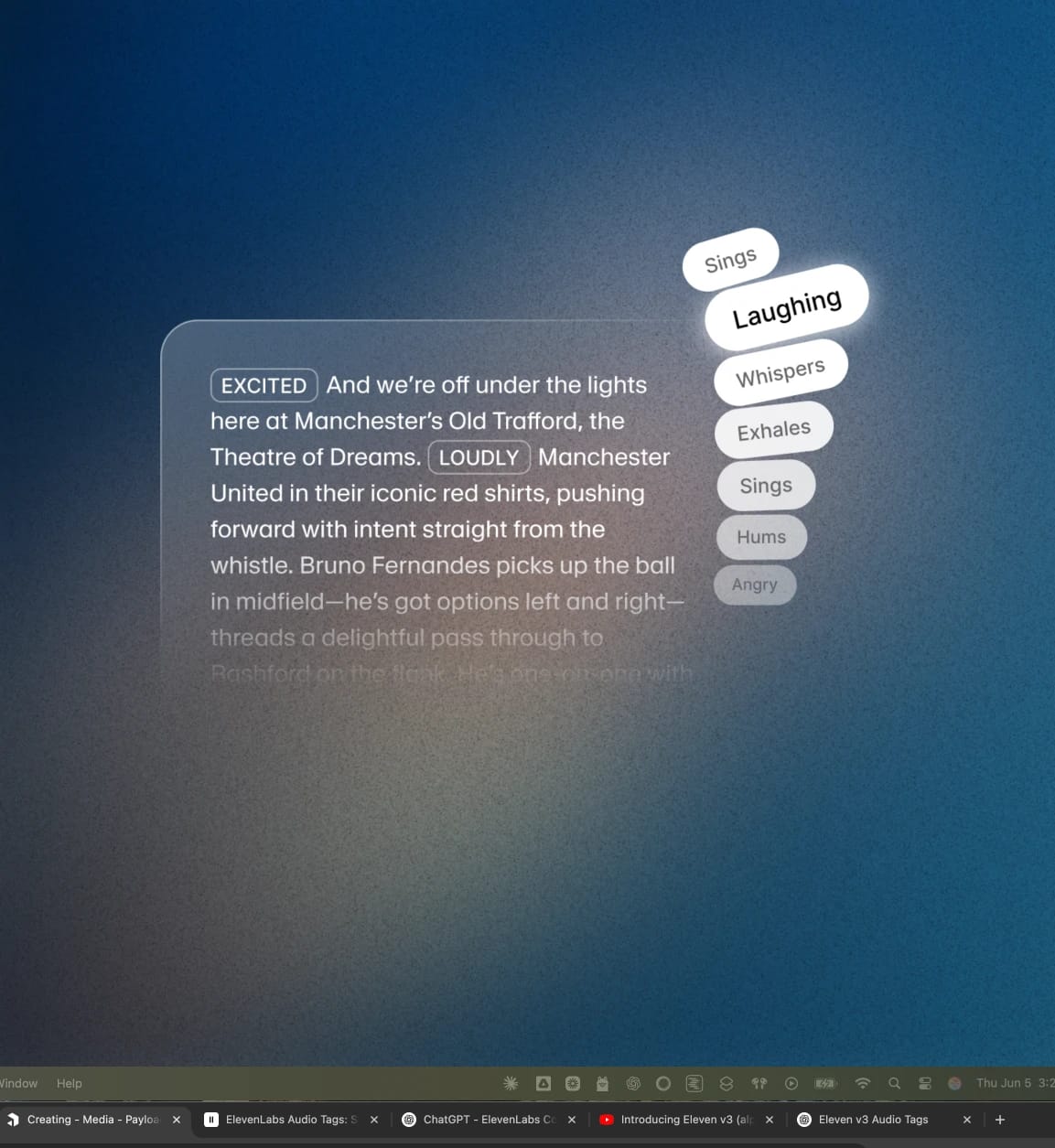

Tryb ekspresyjny ElevenAgents. Pozwala agentom używać tagów takich jak [śmiech], [szept], [westchnienie] czy [wolniej], żeby kontrolować sposób mówienia w kontekście.

Tryb ekspresyjny ElevenAgents.Pozwala agentom używać tagów ekspresji, takich jak [śmiech], [szept], [westchnienie] czy [wolniej], żeby lepiej oddać emocje w rozmowie.

Tryb ekspresyjny ElevenAgents. Pozwala agentom używać tagów ekspresji, takich jak [śmiech], [szept], [westchnienie] i [wolniej], by sterować sposobem mówienia w kontekście.

Dokąd to zmierza

Wiele rozmów z AI nadal przypomina zapytania. Prawdziwe rozmowy takie nie są. Naszym celem jest zlikwidować tę różnicę.