Modelli a cascata vs modelli fusi: come l’architettura determina se il tuo agente vocale è pronto per l’enterprise

- Pubblicato

- Ultimo aggiornamento

AscoltaAscolta questo articolo

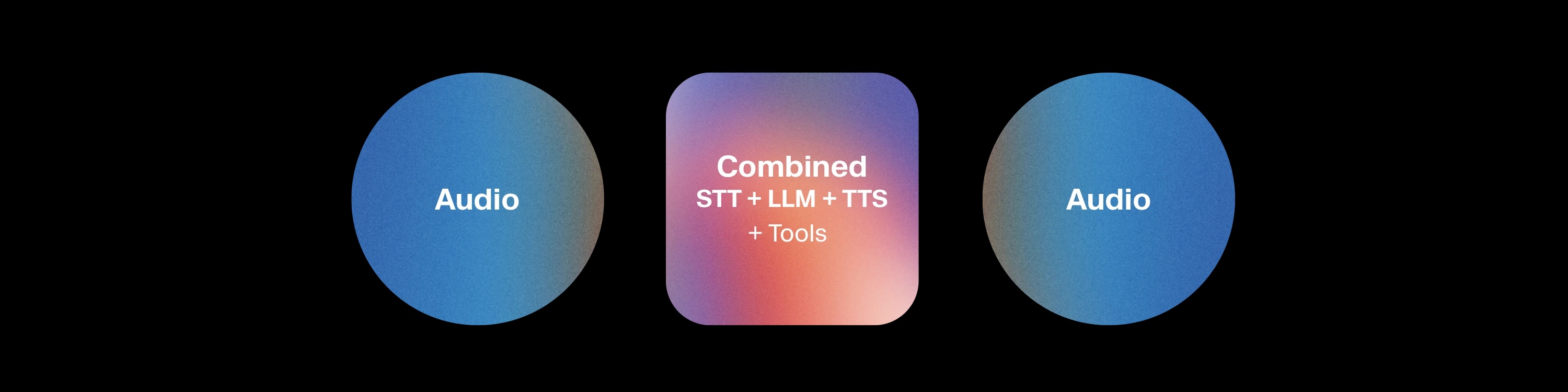

Molti pensano che gli agenti vocali siano costruiti solo con un’architettura a cascata o fusa. In realtà, gli agenti vengono progettati lungo uno spettro tra queste due soluzioni, con cinque architetture tipicamente usate a seconda dell’applicazione.

L’architettura dell’agente determina la sua capacità di comportarsi in modo affidabile in produzione, adattarsi a esigenze aziendali specifiche e risultare naturale nella conversazione. Un’architettura basata sulla fusione, come il modello Realtime di OpenAI, può sembrare molto realistica in scambi brevi. Ma quando i team devono garantire la conformità, risolvere un errore o sostituire un LLM più potente appena disponibile, una rete fusa offre poche possibilità di intervento.

Noi di ElevenLabs utilizziamo un’architettura avanzata basata su cascata. Sfruttiamo componenti specializzati per il riconoscimento vocale, il ragionamento e la generazione del parlato, per garantire intelligenza e affidabilità elevate. Aggiungiamo prosodia contestuale, ottimizzazione della latenza e gestione intelligente dei turni per rendere le conversazioni fluide. Abbiamo scelto questa struttura perché le aziende e le istituzioni con cui collaboriamo richiedono agenti che suonino realistici e siano affidabili in produzione anche per compiti complessi.

In questo articolo analizziamo le cinque principali architetture, i loro punti di forza, i limiti e il nostro approccio alla base degli agenti utilizzati in workflow critici.

Cosa valutano i team nella scelta di un’architettura

Le domande che i team si pongono rientrano di solito in tre categorie.

- Ragionamento e uso di strumenti: Quanto l’agente comprende il contesto, esegue ragionamenti complessi e richiama strumenti esterni o API per completare i compiti.

- Affidabilità: Quanto l’agente si comporta in modo prevedibile – inclusa la capacità di applicare regole di sicurezza, mantenere tono e personalità coerenti e offrire trasparenza tramite trascrizioni, risultati dei test e monitoraggio.

- Prosodia: Quanto l’agente interpreta e risponde in modo naturale – con ritmo, accento e intonazione che rendono l’interazione più umana.

- Latenza: Quanto velocemente l’agente genera una risposta.

- Gestione dei turni: Quanto l’agente rileva con precisione quando rispondere, fare una pausa o cedere la parola in caso di sovrapposizione di voci.

Anche se i team tengono conto di fattori come la concorrenza, le integrazioni e la qualità vocale, le dimensioni sopra elencate sono quelle più direttamente influenzate dall’architettura dell’agente. I team di maggior successo adattano l’architettura per ottimizzare questi aspetti in base al proprio caso d’uso.

Suona e sembra umano?

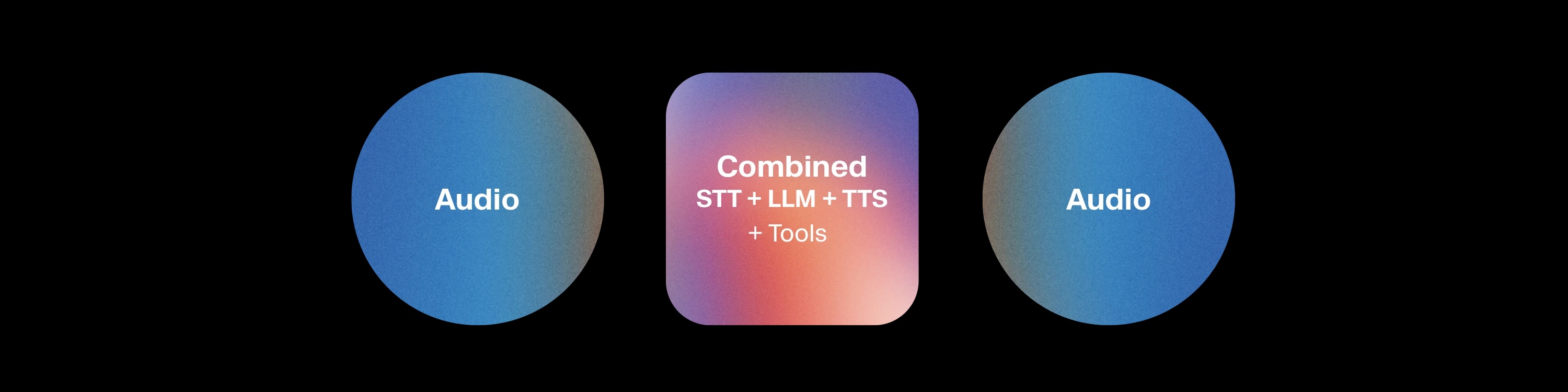

Le architetture a cascata sono costruite collegando tra loro componenti specializzati: Latenza:, un Large Language Model e Text to Speech. Ogni fase può essere ottimizzata, testata e aggiornata in modo indipendente.

Architettura a cascata

.webp&w=3840&q=95)

Questa modularità permette ai team di integrare gli LLM più avanzati per un ragionamento migliore, applicare regole di sicurezza esplicite a livello testuale e controllare con precisione come l’agente parla tramite TTS contestuale. Il principale compromesso è che le architetture a cascata tendono a perdere più segnali prosodici – come intonazione, ritmo ed emozione – perché il parlato viene convertito in testo prima di essere rigenerato. Questi segnali possono essere in parte recuperati tramite modelli espliciti, ma non vengono catturati in modo naturale come negli approcci fusi. Altri aspetti, come latenza e gestione dei turni, possono essere ottimizzati in modo simile in entrambi gli approcci.

I compromessi tra architetture a cascata e fusa

Modello fuso

Questa struttura permette alle architetture basate sulla fusione di preservare e riprodurre la prosodia in modo più efficace, dato che il modello elabora direttamente pronuncia e intonazione. Tuttavia, i modelli fusi sono più difficili da testare e controllare, perché gli output intermedi non sono accessibili. Inoltre, tendono a basarsi su LLM più leggeri, il che limita le capacità di ragionamento e di utilizzo di strumenti rispetto agli approcci a cascata che possono sfruttare i modelli più potenti disponibili.

Questa modularità rende le architetture a cascata la base della maggior parte degli agenti enterprise. Ogni fase produce output ispezionabili: testo leggibile tra STT e LLM, tra LLM e TTS. I guardrail possono essere applicati a livello di testo, è possibile integrare l’ultimo LLM di frontiera senza modificare i modelli vocali e, in caso di errore, la causa è generalmente identificabile.

La critica storica alle architetture a cascata è la perdita dei segnali prosodici. Il parlato viene ridotto a testo e intonazione, ritmo ed emozione devono essere ricostruiti in uscita. Questi segnali possono essere parzialmente recuperati tramite modelli espliciti, ma non sono catturati in modo naturale come nelle soluzioni fuse. Altri aspetti, come latenza e gestione dei turni, possono essere ottimizzati in modo simile in entrambe le architetture.

1. Cascata di base

Questa assenza di fasi intermedie è sia un vantaggio che un limite. L’architettura fusa può mantenere naturalmente le sfumature prosodiche, perché il parlato non viene mai convertito in testo. Tuttavia, è più difficile applicare sistemi di sicurezza, sostituire singoli componenti o ispezionare output intermedi per il debug. Ci sono anche limiti nel personalizzare lo STT per terminologia di settore o integrare un LLM diverso per un ragionamento più avanzato e chiamate agli strumenti. Il sistema è una sola rete e i team sono vincolati alle capacità di ragionamento con cui viene fornito, che oggi significa core più leggeri che non possono competere con i migliori LLM nei compiti complessi.

Le cinque architetture

1. Cascata base

- Assistenza clienti

- Assistenti alle vendite

- Receptionist IA

- NPC per intrattenimento e gaming

- Sostituzione IVR

- Gestione FAQ e onboarding alla documentazione

- Notifiche in uscita (promemoria, avvisi, conferme appuntamenti)

L’audio viene trascritto, l’LLM genera una risposta testuale e il TTS la riproduce. Ogni fase lavora su testo semplice, così puoi vedere, testare e controllare tutto.

Esempi d’uso:

Questo è l’approccio alla base della modalità Gestione FAQ per onboarding SaaS in ElevenAgents, che abbina un modello TTS contestuale capace di adattare tono ed emozione tra i turni a un sistema avanzato di gestione dei turni basato sui segnali di Scribe v2 Realtime. Insieme, permettono una resa più espressiva e ricca di sfumature emotive, senza rinunciare a modularità o controllo.

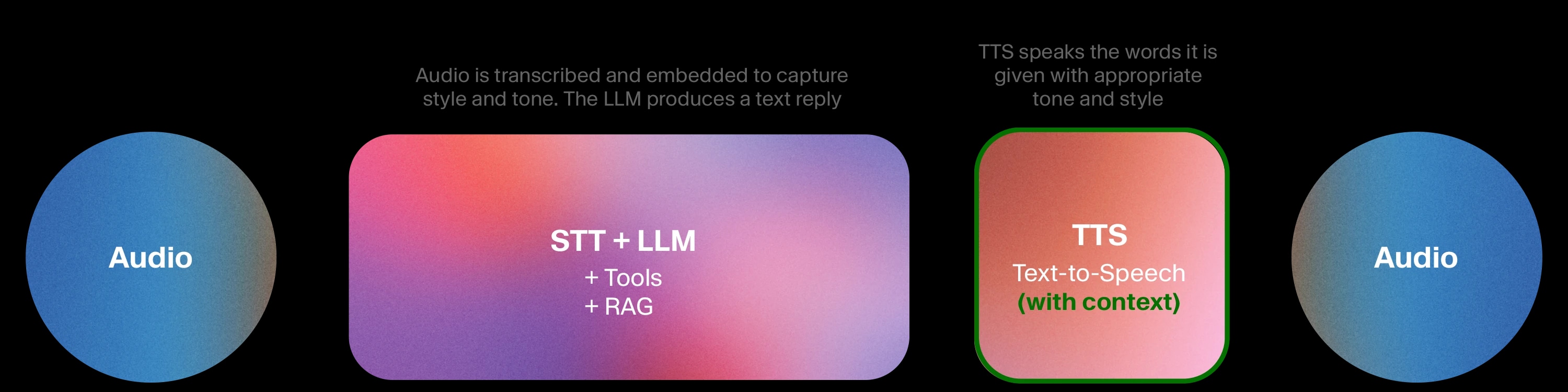

2. Cascata avanzata

- Assistenza clienti

- Assistenti alle vendite

- Receptionist IA

- NPC per intrattenimento e gaming

La stessa architettura modulare, ma ora più componenti lavorano con un contesto più ricco. È ciò che abbiamo realizzato con

L’architettura mantiene tutti i vantaggi della cascata base: piena trasparenza, guardrail a livello di testo, possibilità di sostituire i componenti, tuning di dominio e accesso ai migliori modelli di ragionamento e tool-calling disponibili. In più offre prosodia, latenza e gestione dei turni nettamente migliori. I team possono integrare un nuovo LLM di frontiera appena esce, o ottimizzare lo STT per il linguaggio medico, senza dover ricostruire altri componenti.

- Supporto clienti per servizi finanziari, dove una risposta empatica su una contestazione si abbina a guardrail rigorosi e tracciamento completo delle interazioni

- Receptionist in ambito sanitario che smistano le chiamate dei pazienti con la giusta urgenza, flussi conformi a HIPAA e riconoscimento vocale ottimizzato per la terminologia medica

3. Cascata e fusione ibride

Alcune architetture inviano le caratteristiche acustiche (pronuncia, emozione, tono) del parlato direttamente all’LLM come embedding, invece di convertirle prima in testo. Il TTS resta modulare.

Questo fornisce all’LLM un input più ricco su

- Apprendimento linguistico e coaching sulla pronuncia, dove sentire

- Supporto sensibile al tono con bassa complessità, dove rilevare la frustrazione è importante ma il compito è semplice.

4. Fusione sequenziale

Un unico modello multimodale gestisce riconoscimento, ragionamento e generazione in un solo passaggio, un turno alla volta.

Possibili casi d’uso:

- Compagni sperimentali, chatbot e app vocali social

Esempi d’uso:

Non esiste un’architettura universale per gli agenti conversazionali. Ogni variante ha punti di forza e compromessi, dalla prevedibilità e controllo dei modelli a cascata alla naturalezza prosodica di quelli fusi.

Input e output vengono elaborati contemporaneamente, con il modello che ascolta e parla allo stesso tempo. Questo può rendere gli scambi brevi sorprendentemente naturali, con sovrapposizione reale delle voci e transizioni fluide.Speech to Text, LLM e Text to Speech per ottimizzare agenti intelligenti, personalizzabili e affidabili. Integriamo poi segnali prosodici, ottimizzazioni della latenza e un modello di gestione dei turni per risposte vocali naturali.

È anche l’architettura più difficile da controllare: i guardrail sono molto difficili da applicare e la sovrapposizione delle voci introduce errori imprevedibili. Ispezionare, tracciare o fare debug è estremamente complesso e il sistema è in gran parte chiuso, con poche possibilità di sostituire componenti, fare tuning di dominio o personalizzare. Ragionamento e uso di strumenti sono ancora più limitati rispetto ai modelli fusi sequenziali, perché l’elaborazione simultanea lascia meno spazio a logiche complesse. E la stessa simultaneità che rende naturali gli scambi brevi rende instabili le conversazioni più lunghe.