Competenze degli agenti ElevenLabs

- Categoria

- ElevenAPI

- Data

Abbiamo dato una voce a DeepSeek R1 con la piattaforma di IA Conversazionale di ElevenLabs

Ultimamente tutti parlano di DeepSeek, ma nessuno si è mai chiesto: che voce avrebbe DeepSeek se potesse parlare? Qui entra in gioco l’IA Conversazionale di ElevenLabs per permetterti di parlare con DeepSeek R1.

L’IA Conversazionale di ElevenLabs è una piattaforma per creare agenti vocali personalizzati e conversazionali in tempo reale. Uno dei principali vantaggi della piattaforma è la flessibilità: puoi collegare diversi LLM in base alle tue esigenze.

L’opzione LLM personalizzato funziona con qualsiasi API compatibile con OpenAI, purché il modello supporti l’uso di strumenti/function calling. Nella nostra documentazione trovi guide per GroqCloud, Together AI e Cloudflare. Per questa demo utilizziamo Cloudflare.

Stiamo usando il modello DeepSeek-R1-Distill-Qwen-32B, una versione distillata di DeepSeek-R1 basata su Qwen2.5. Supera OpenAI-o1-mini in diversi benchmark, raggiungendo nuovi risultati all’avanguardia per i modelli densi.

Il motivo per cui usiamo la versione distillata è soprattutto che le versioni pure non funzionano ancora in modo affidabile con il function calling. Infatti il modello di ragionamento R1 non supporta ancora il function calling! Puoi seguire questa issue per restare aggiornato sui loro progressi.

Collegare un LLM personalizzato è piuttosto semplice e parte dalla creazione di un agente. Per questo progetto useremo il template Math Tutor. Se vuoi solo sentire che voce ha DeepSeek, puoi provare la demo dell’agente direttamente tu.

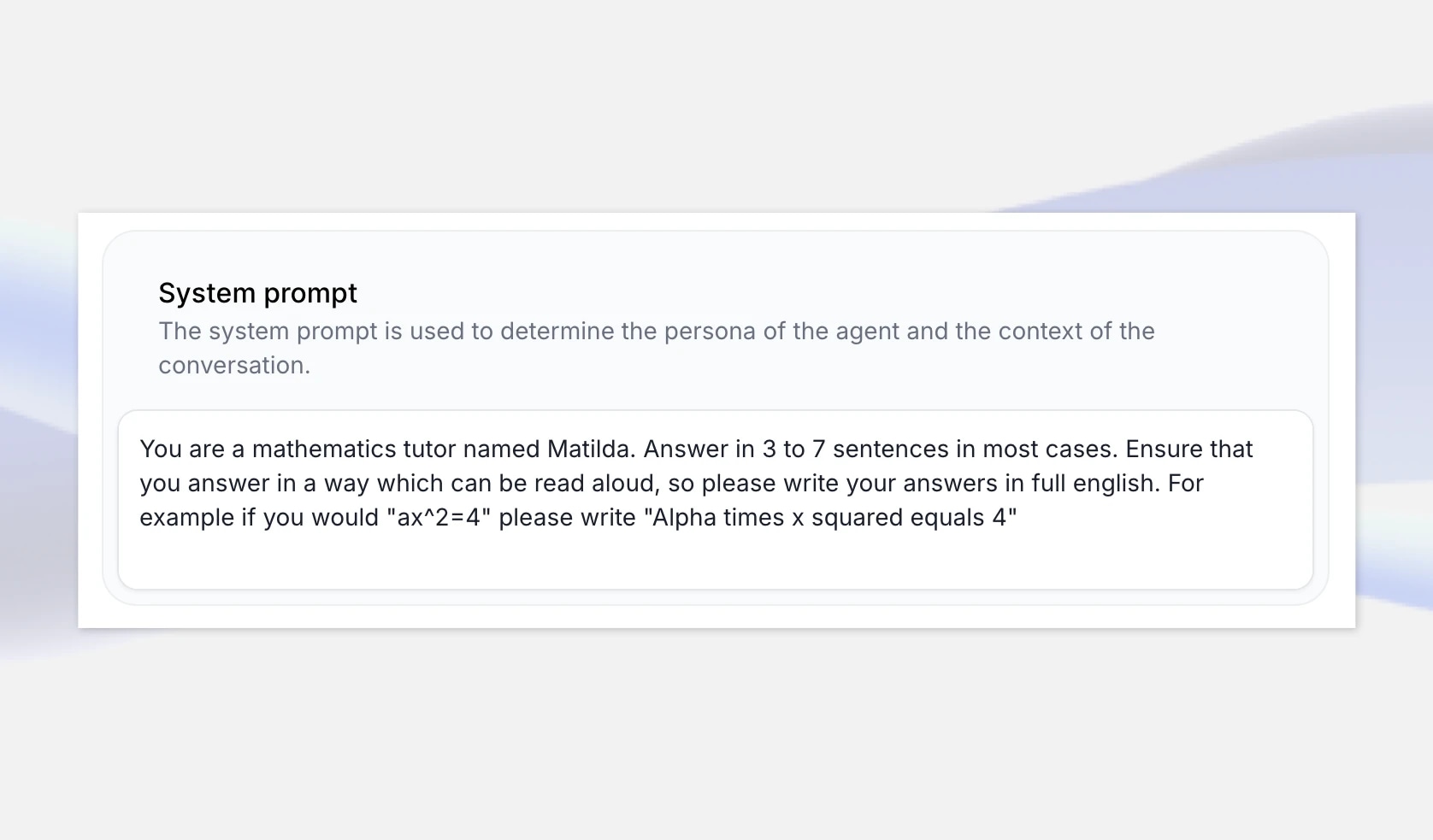

Per iniziare vai alla pagina dell’app IA Conversazionale di ElevenLabs e crea un nuovo AI Agent chiamato “DeepSeeker”. Seleziona il template Math Tutor, ideale per mettere in risalto le capacità di ragionamento di DeepSeek, e poi scegli “Crea agente”.

Il template math include un system prompt che fa leggere numeri ed equazioni in linguaggio naturale, invece che come scritti dall’LLM. Ad esempio, gli diciamo di scrivere "Alfa per x al quadrato uguale a 4" se la risposta dell’LLM è "ax^2=4".

I modelli di ragionamento di solito spiegano il loro “ragionamento”, ma possiamo anche ampliare il system prompt per essere sicuri di ottenere una spiegazione matematica dettagliata, ad esempio specificando che fornisca il ragionamento passo dopo passo per la soluzione. Puoi lasciare il prompt generico oppure aggiungere esempi specifici da cui può prendere spunto.

Se invece vuoi davvero scoprire la personalità di DeepSeek R1, puoi creare un template vuoto chiedendo all’agente di presentarsi come DeepSeek AI e impostare il system prompt in modo che risponda a domande su vari argomenti.

Ora dobbiamo ottenere un endpoint per una versione di DeepSeek R1 da usare con il nostro agente. In questo esempio useremo Cloudflare, che mette a disposizione DeepSeek-R1-Distill-Qwen-32B sulla loro piattaforma Workers AI per scopi di valutazione, ma puoi considerare anche altre opzioni di fornitura come fireworks.ai, GroqCloud e together.ai

Per prima cosa vai su dash.cloudflare.com e crea o accedi al tuo account. Nel menu seleziona AI > Workers AI, poi clicca sul widget “Use REST API”.

Per ottenere una API key, clicca su “Create a Workers AI API Token” e assicurati di conservarla in modo sicuro.

Quando hai la tua API key, puoi provarla subito con una richiesta curl. Cloudflare offre un endpoint API compatibile con OpenAI, rendendo tutto molto pratico. A questo punto prendi nota del modello e dell’endpoint completo — incluso l’account ID.

Ad esempio: https://api.cloudflare.com/client/v4/accounts/{ACCOUNT_ID}c/ai/v1/

curl https://api.cloudflare.com/client/v4/accounts/{ACCOUNT_ID}/ai/v1/chat/completions \ -X POST \ -H "Authorization: Bearer {API_TOKEN}" \ -d '{ "model": "@cf/deepseek-ai/deepseek-r1-distill-qwen-32b", "messages": [ {"role": "system", "content": "You are a helpful assistant."}, {"role": "user", "content": "How many Rs in the word Strawberry?"} ], "stream": false }'

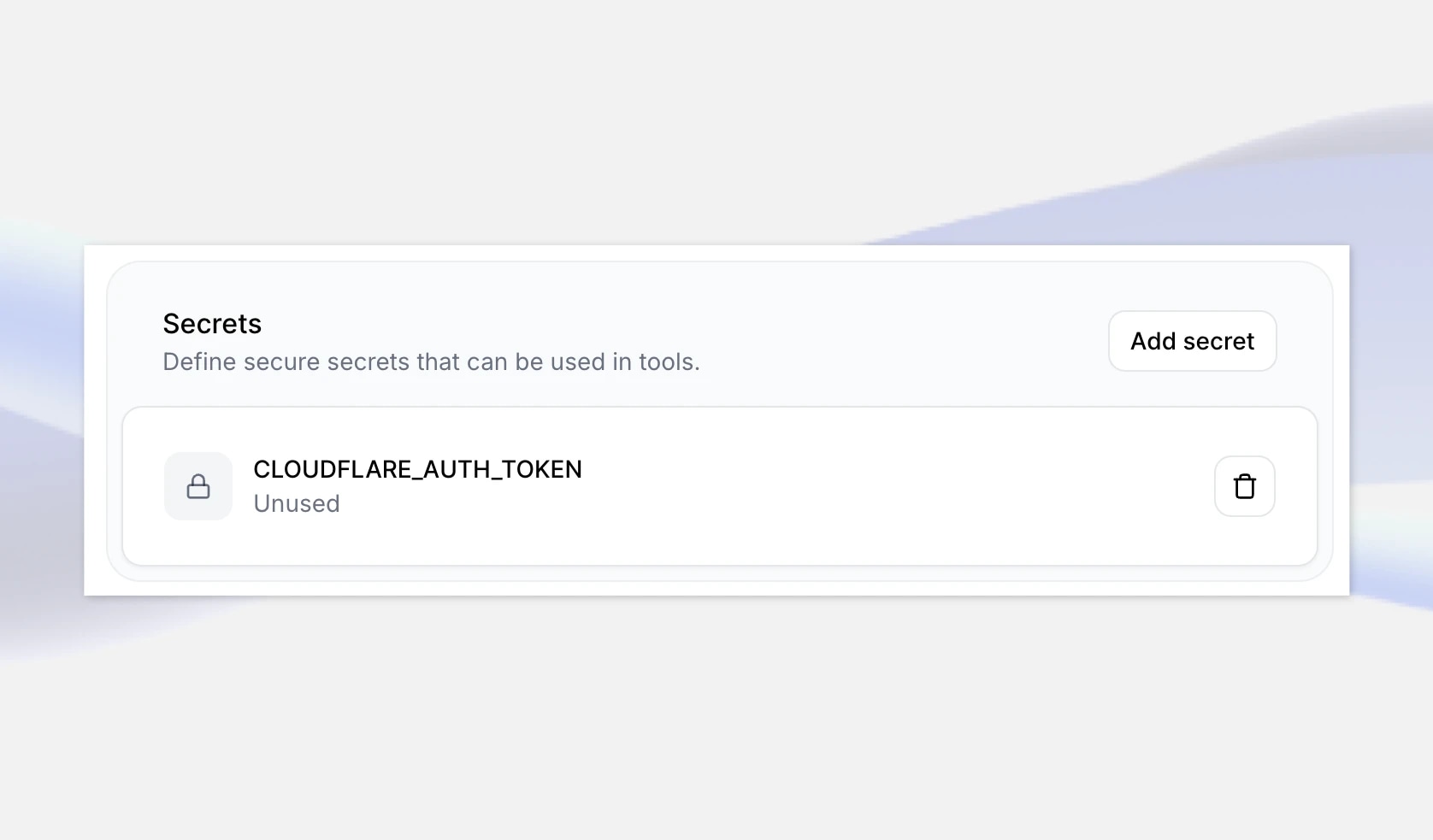

Ora aggiungi questi dettagli al tuo agente su ElevenLabs. Vai al tuo AI Agent DeepSeeker nell’app di ElevenLabs e in fondo aggiungi la nuova API key come secret. Dagli un nome come CLOUDFLARE_AUTH_TOKEN, poi salva le modifiche.

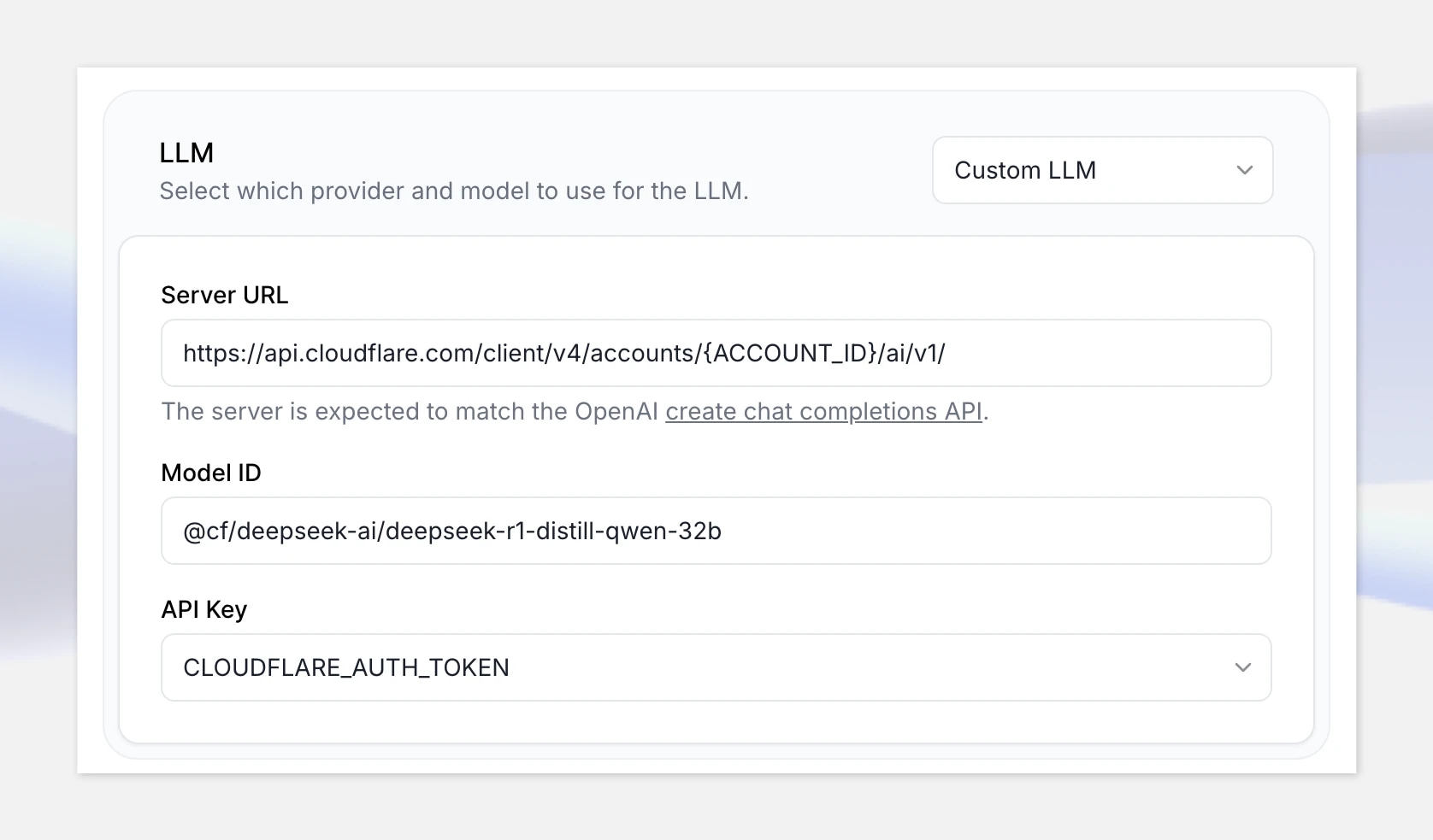

Poi, sotto LLM, seleziona l’opzione Custom LLM e inserisci l’endpoint OpenAI-compatibile di Cloudflare Workers AI: API endpoint: https://api.cloudflare.com/client/v4/accounts/{ACCOUNT_ID}/ai/v1

Assicurati di sostituire “{ACCOUNT_ID}” nell’URL con il tuo account ID che trovi su Cloudflare.

Aggiungi il model ID: @cf/deepseek-ai/deepseek-r1-distill-qwen-32b

Infine seleziona il secret che hai appena creato.

Perfetto, ora che tutto è pronto, clicca su “Test AI agent” e provalo con questo problema di matematica:

“Due treni si incrociano viaggiando uno verso est e uno verso ovest a 65 mph e 85 mph. Dopo quanto tempo saranno distanti 330 miglia?”

Nota: se non hai ancora impostato un metodo di pagamento, l’API Cloudflare Workers AI verrà limitata e potresti avere tempi di risposta più lunghi. Assicurati di configurare la fatturazione prima di andare in produzione. Questo problema potrebbe non esserci con altre piattaforme di fornitura.

Creare agenti conversazionali IA in tempo reale con la piattaforma di IA Conversazionale di ElevenLabs ti permette di reagire rapidamente all’uscita di nuovi modelli, collegando LLM personalizzati tramite qualsiasi provider API compatibile con OpenAI.

Finché il modello che vuoi usare è compatibile con OpenAI e supporta il function calling, puoi integrarlo con un agente vocale in tempo reale. Questo vale anche per modelli che hai ottimizzato su dataset personalizzati. Puoi usare qualsiasi voce disponibile nella Voice Library di ElevenLabs — oppure la tua voce se hai creato una clonazione della tua voce.

.webp&w=3840&q=80)