ElevenLabs UI 소개: 웹을 위한 오픈소스 오디오 & 에이전트 컴포넌트

- 카테고리

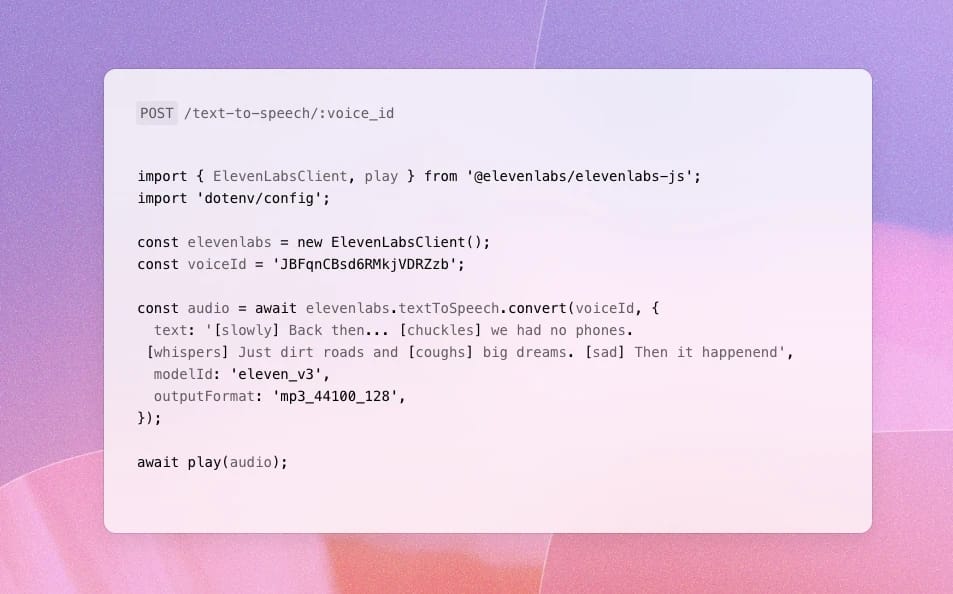

- ElevenAPI

- 날짜

견고한 평가 기준과 대화 시뮬레이션을 활용해 대화형 AI 에이전트를 효과적으로 테스트하고 개선하는 방법을 알아보세요.

대화형 보이스 에이전트가 실제로 운영될 때, 어떻게 대규모로 모니터링할 수 있을까요? 의도와 다르게 동작할 때는 어떻게 알아챌 수 있을까요? 그리고 변경 후에는 어떻게 테스트할 수 있을까요?

이런 질문들이 저희가 El, 문서 어시스턴트( 대화형 AI)를 개발하는 데 큰 영향을 주었습니다. El이 발전하면서, 저희는 평가 기준과 대화 시뮬레이션을 기반으로 에이전트를 모니터링하고 평가하며 테스트하는 시스템을 구축했습니다.

에이전트를 개선하려면 실제 환경에서 어떻게 동작하는지 파악하는 것이 먼저입니다. 이를 위해 평가 기준을 다듬고, 에이전트 성능을 정확하고 신뢰성 있게 모니터링할 수 있도록 했습니다. 저희는 에이전트가 잘못된 정보를 제공하거나 사용자가 원하는 목표를 달성하지 못하게 할 때를 실패한 대화로 정의합니다.

만약 상호작용이 실패하면 대화 자체가 유효하지 않습니다. 다른 기준에서 실패가 발생하면 추가로 원인을 조사합니다. 이 조사가 에이전트 개선 방향을 결정합니다. 때로는 도구 사용법이나 타이밍을 다듬는 것이고, 때로는 지원하지 않는 행동을 막기 위한 가드레일을 추가하는 일입니다.

개선할 점을 찾았다면, 다음 단계는 테스트입니다. 여기서 저희의 대화 시뮬레이션 API가 활용됩니다. 실제와 유사한 사용자 시나리오를 전체 또는 특정 구간별로 시뮬레이션하고, 운영 환경과 동일한 기준으로 결과를 자동 평가합니다. 도구 모킹과 맞춤 평가도 지원해 특정 행동 테스트에 유연하게 사용할 수 있습니다.

명확하고 집중된 시나리오를 통해 LLM이 어떤 부분을 테스트받는지 통제할 수 있어, 예외 상황, 도구 사용, 폴백 로직까지 꼼꼼하게 검증할 수 있습니다.

마지막 단계는 자동화입니다. ElevenLabs의 오픈 API를 활용해 GitHub DevOps 플로우와 연동하고, 평가와 시뮬레이션을 CI/CD 파이프라인에 내장했습니다. 모든 업데이트는 배포 전에 자동으로 테스트되어, 성능 저하를 방지하고 실제 환경에서의 빠른 피드백을 받을 수 있습니다.

이 과정을 통해 El을 개발하고 관리하는 방식이 완전히 달라졌습니다. 실제 사용과 구조화된 평가, 집중 테스트, 자동 검증이 연결된 피드백 루프를 만들어, 더 빠르고 자신 있게 개선 사항을 적용할 수 있게 되었습니다.

이 프레임워크는 이제 저희가 만드는 모든 에이전트에 적용할 수 있습니다.

.webp&w=3840&q=80)