RE:ANIME

SYNCHRONISATIONSSTUDIO

Lokalisieren Sie Inhalte in 29 Sprachen mit KI-Dubbing

Übersetzen Sie Audio und Video, während Sie die Emotion, das Timing, den Ton und die einzigartigen Merkmale jedes Sprechers bewahren

KI-Dubbing mit Originalstimmen

Unser Dubbing-Tool bewahrt die Stimme und den Stil des ursprünglichen Sprechers in allen unterstützten Sprachen, sodass Ihre Inhalte weltweit emotional und akustisch authentisch bleiben

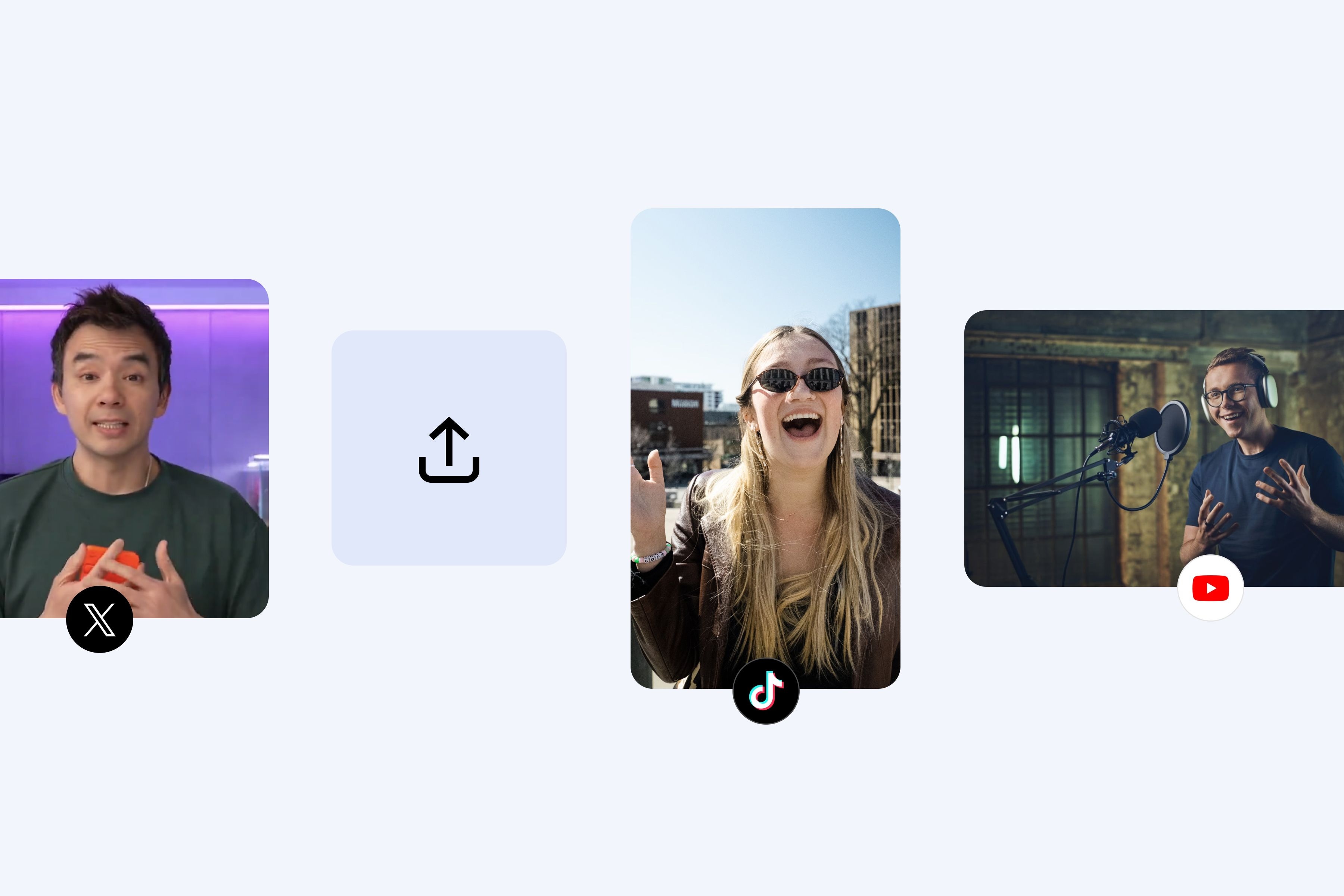

Sofortiges Dubbing von jeder Quelle

Laden Sie Ihre Videos hoch oder verlinken Sie sie von jeder Plattform, sei es YouTube, X/Twitter, TikTok, Vimeo oder eine URL, und beginnen Sie sofort mit der Übersetzung, egal wo Ihre Inhalte leben

Vollständig verwaltetes Dubbing mit ElevenStudios

Erreichen Sie ein globales Publikum, indem Sie Ihre Inhalte für ausländische Zuschauer übersetzen. Lassen Sie unsere KI und zweisprachigen Dubbing-Experten die Arbeit für Sie erledigen.

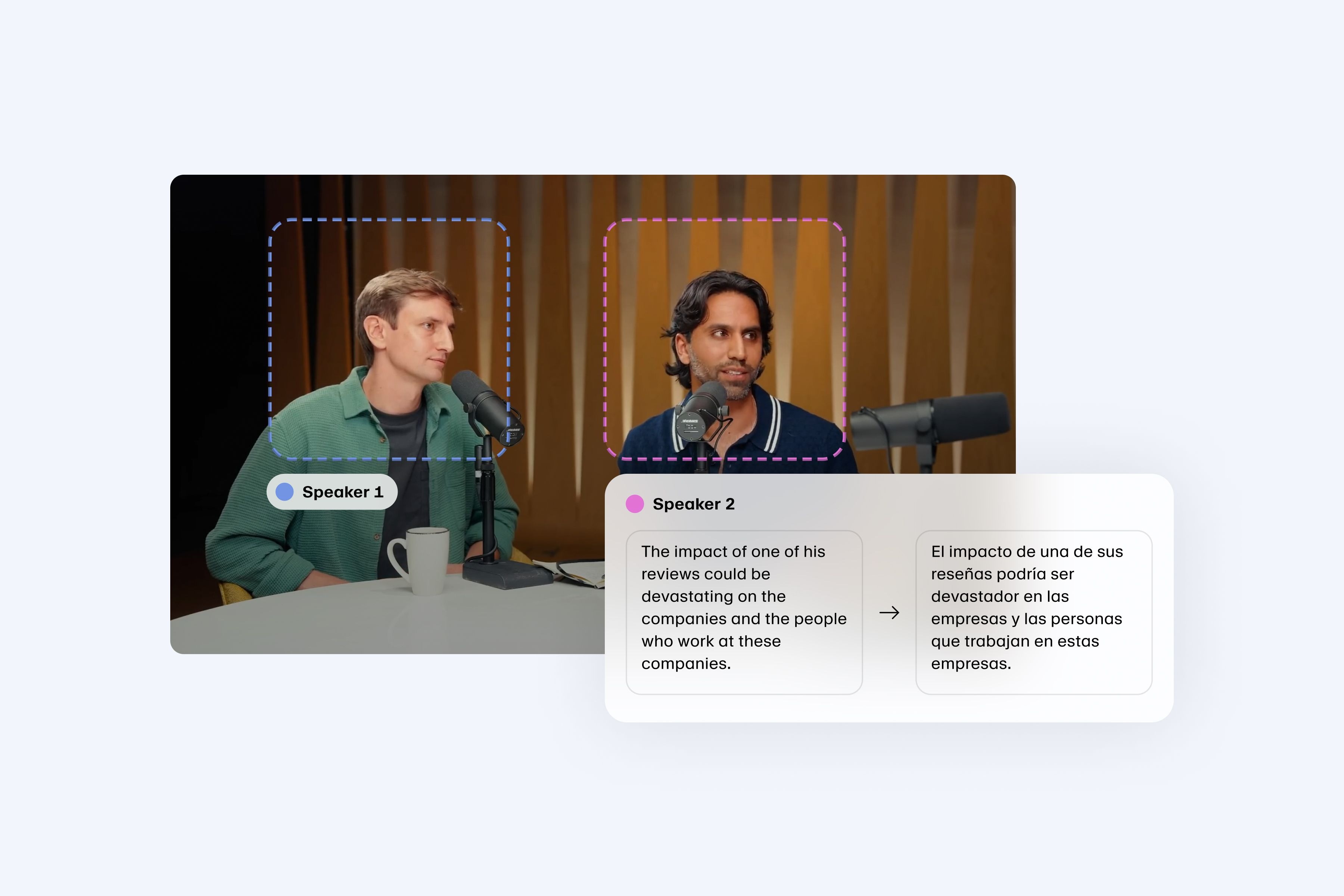

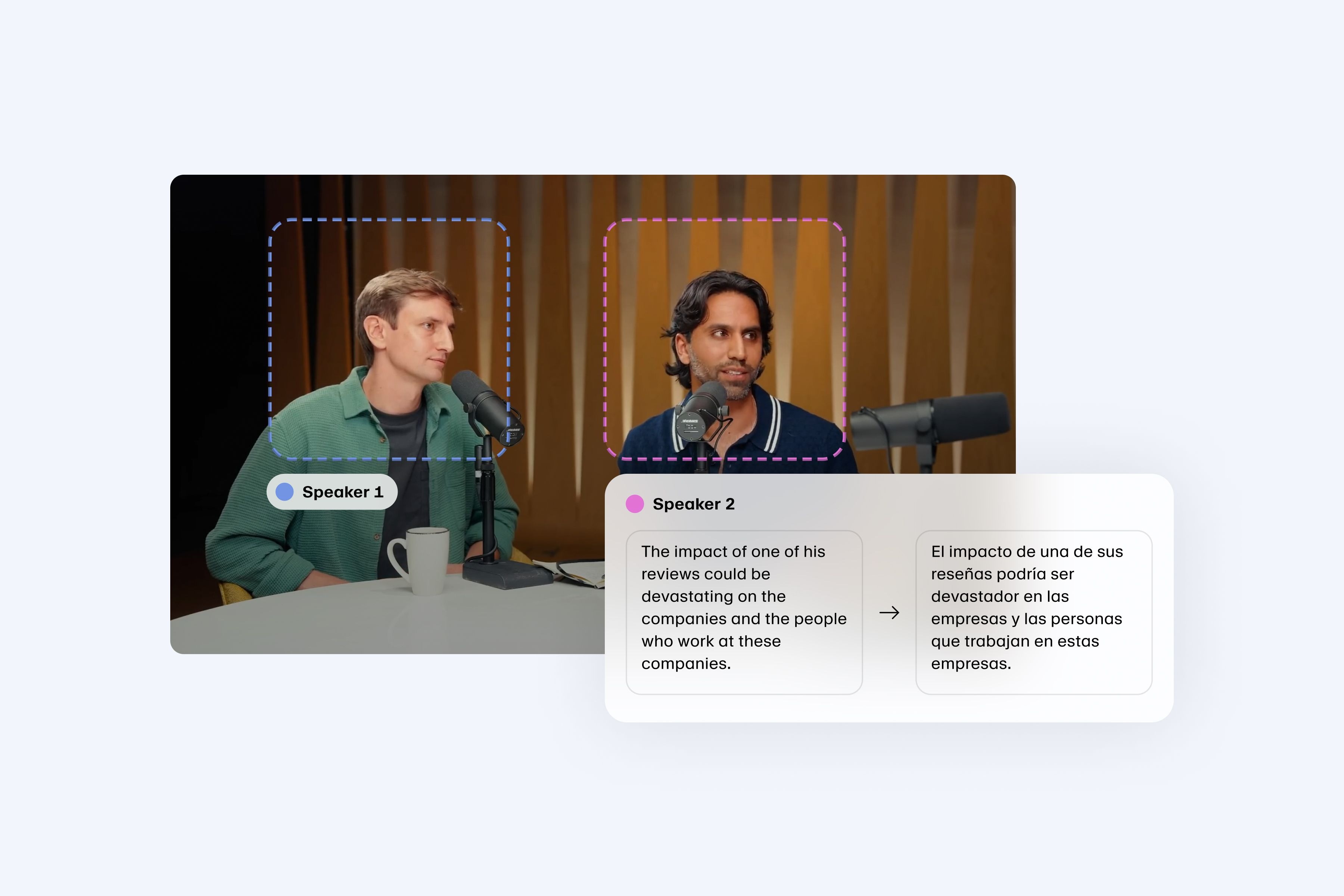

Automatische Sprechererkennung

Unsere Dubbing-KI analysiert Ihr Video und erkennt automatisch, wer wann spricht, um sicherzustellen, dass alle Stimmen den ursprünglichen Sprechern in Inhalt, Intonation und Sprechdauer entsprechen

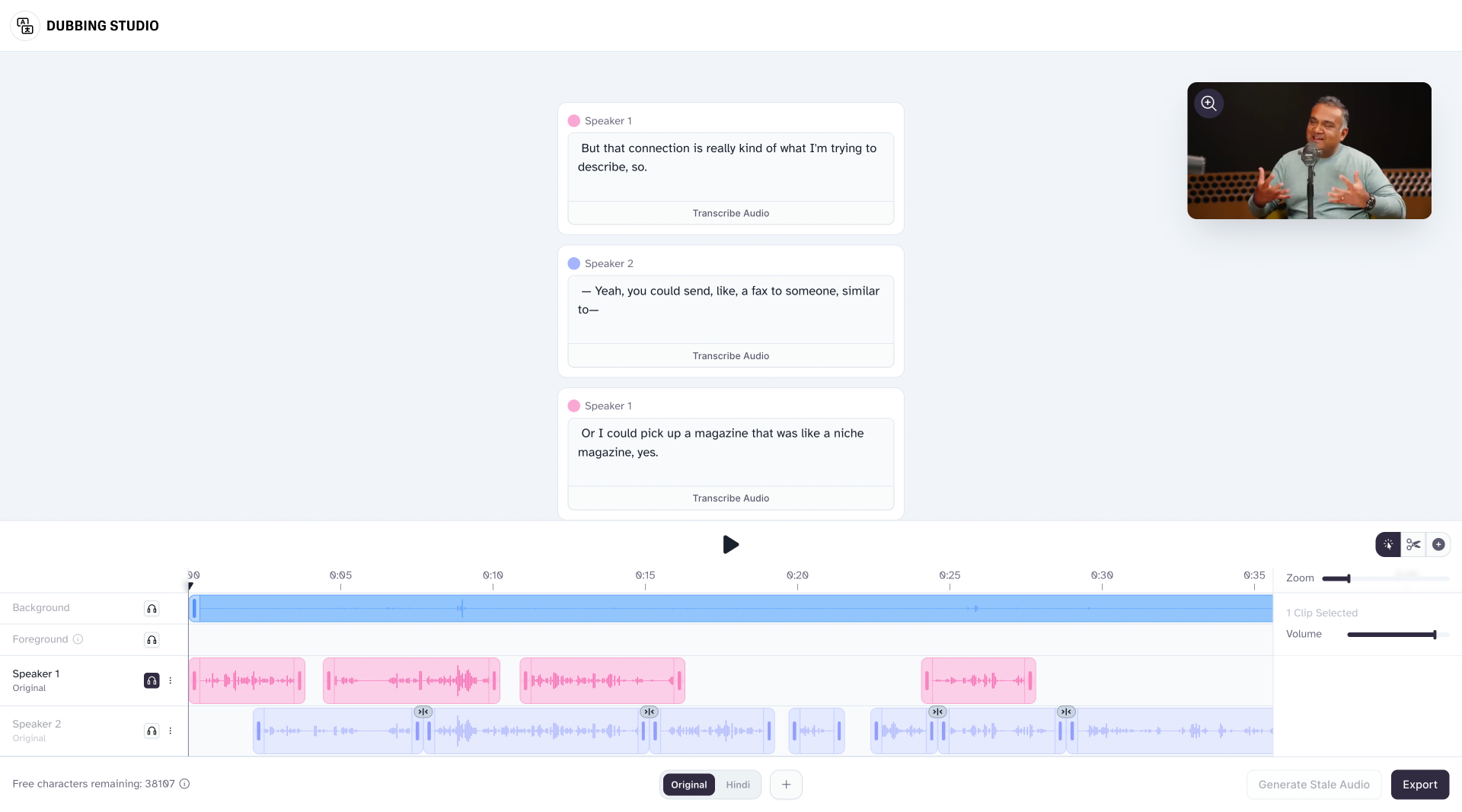

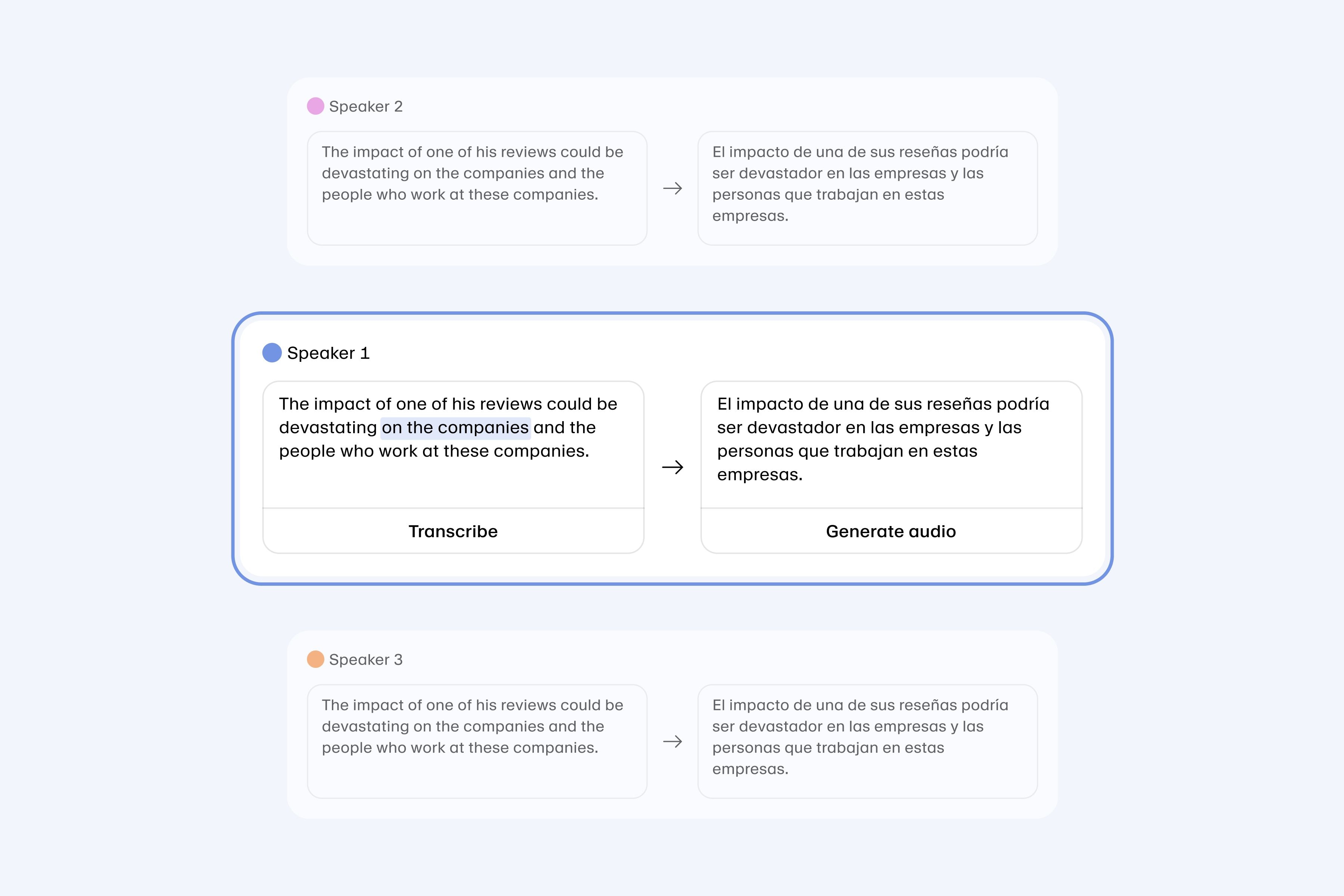

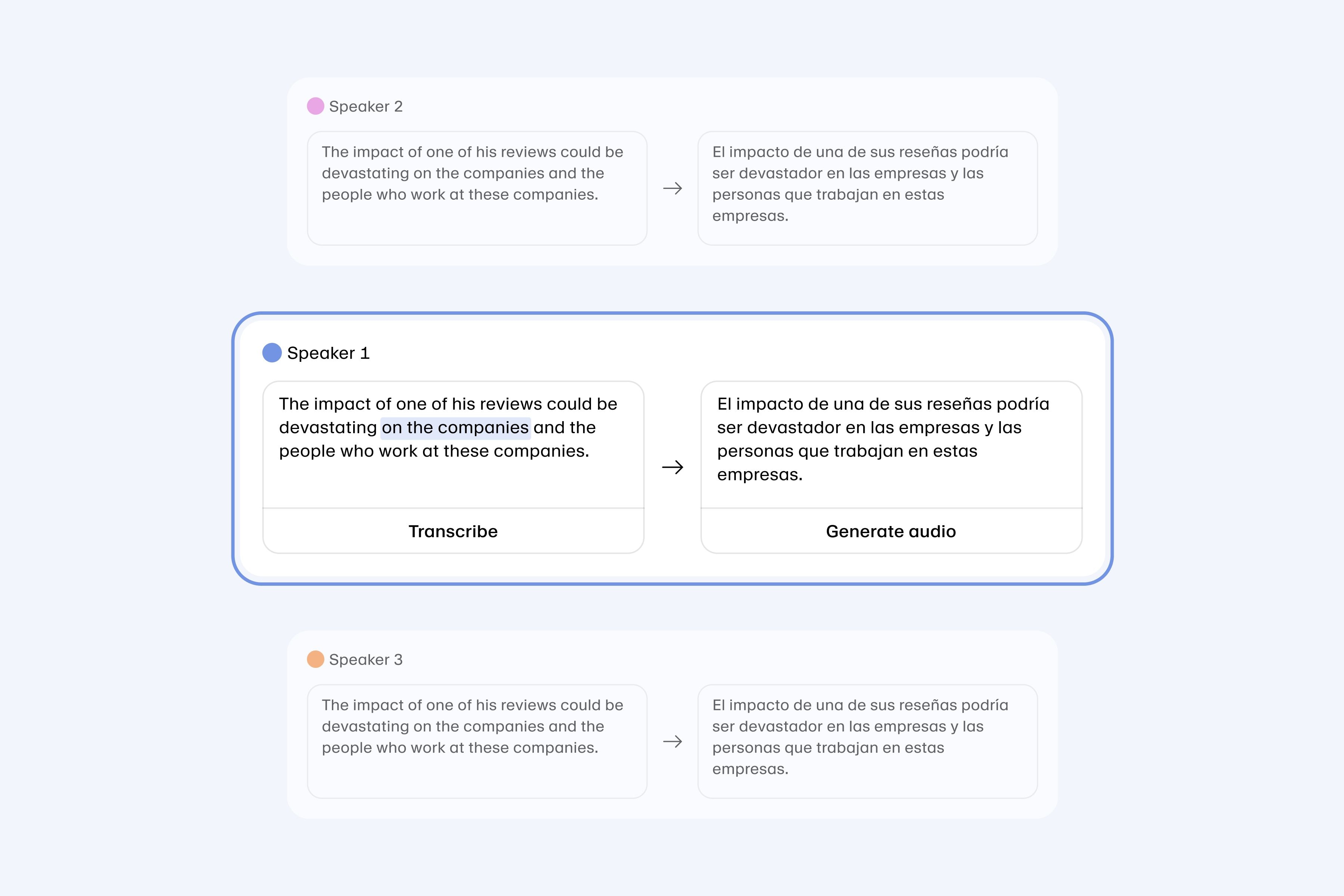

Bearbeitung von Video-Transkripten und Übersetzungen

Unser KI-Videoübersetzer ermöglicht es Ihnen, Transkripte und Übersetzungen manuell zu bearbeiten, um sicherzustellen, dass Ihre Inhalte richtig synchronisiert und lokalisiert sind. Passen Sie die Stimmeinstellungen an, um die Wiedergabe zu optimieren, und regenerieren Sie Sprachsegmente, bis das Ergebnis perfekt klingt

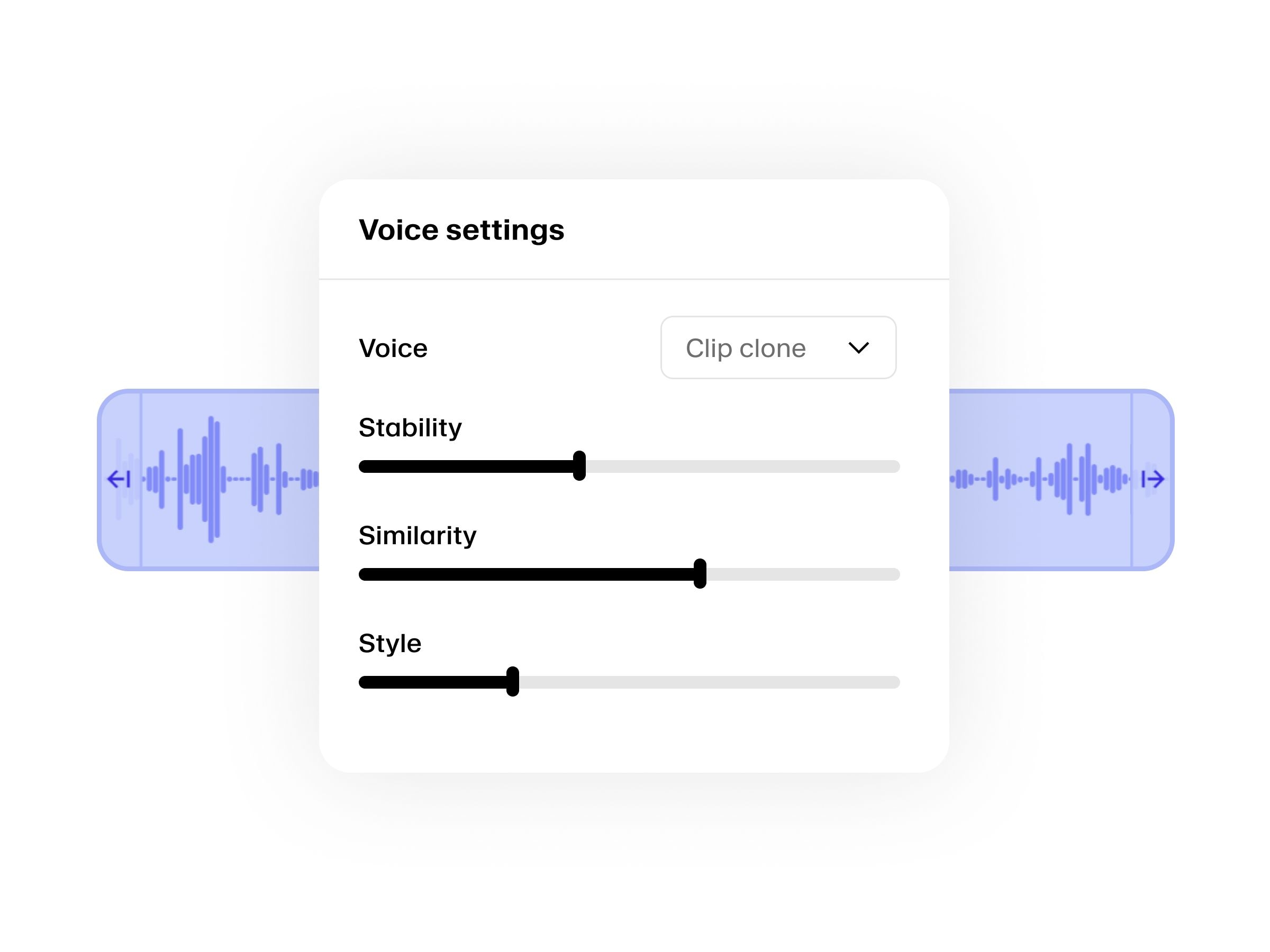

Tracks anpassen

Personalisieren Sie jeden Audiotrack mit spezifischen Einstellungen wie Stabilität, Ähnlichkeit und Stil, um die Sprachausgabe für jeden Charakter in Ihrem Projekt zu optimieren

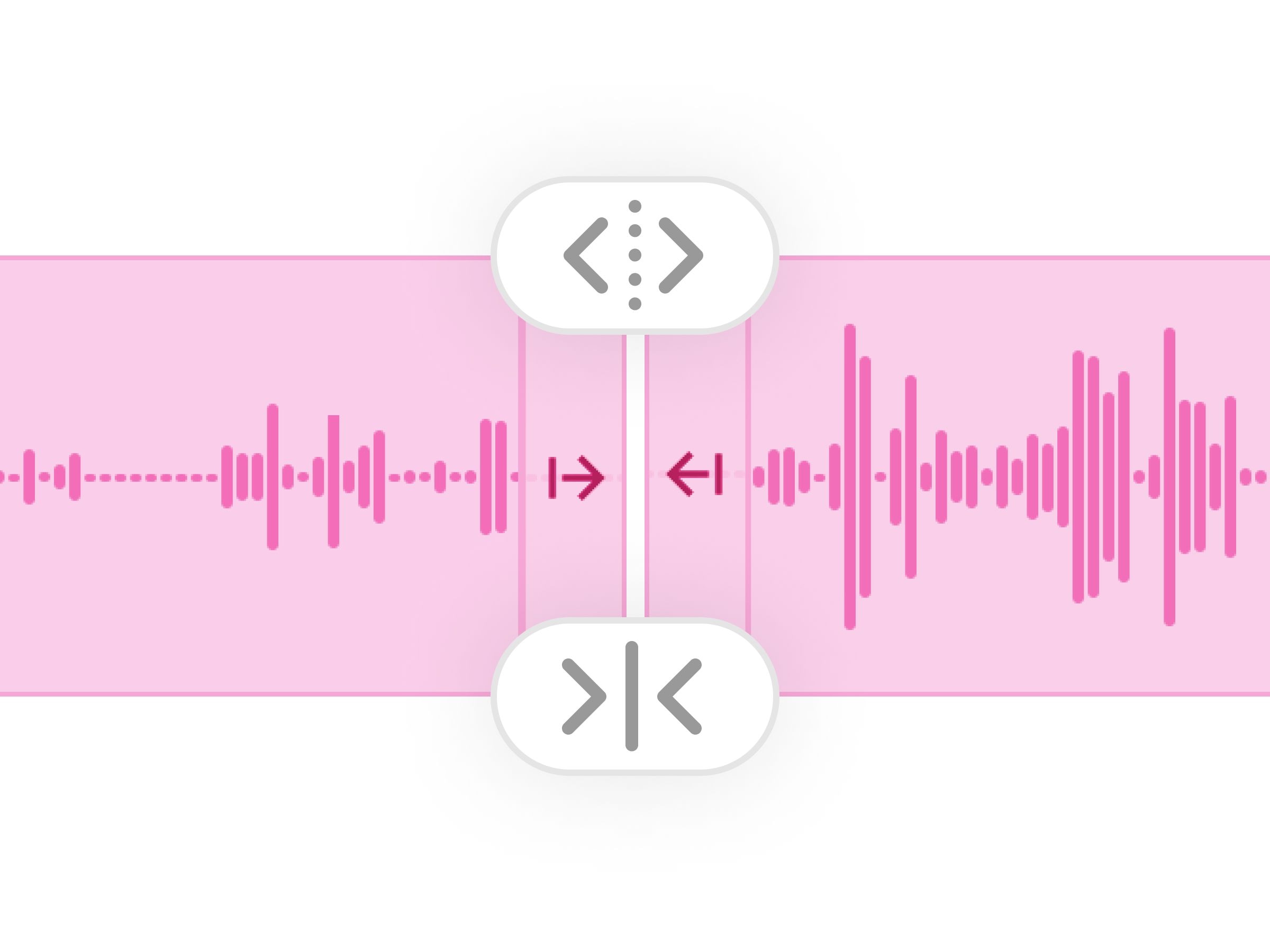

Clips verwalten

Fügen Sie Clips zusammen, teilen, löschen oder verschieben Sie sie, um das Audio Ihres Projekts genau an die Anforderungen Ihrer Szene oder Ihres Dialogs anzupassen und den Dialog mit der Aktion auf dem Bildschirm zu synchronisieren

Clips regenerieren

Aktualisieren Sie jeden Dub-Clip mit neuen Einstellungen oder Übersetzungen, um sicherzustellen, dass Ihr Audio perfekt zu Ihren neuesten Bearbeitungen passt und Konsistenz und Qualität beibehält.

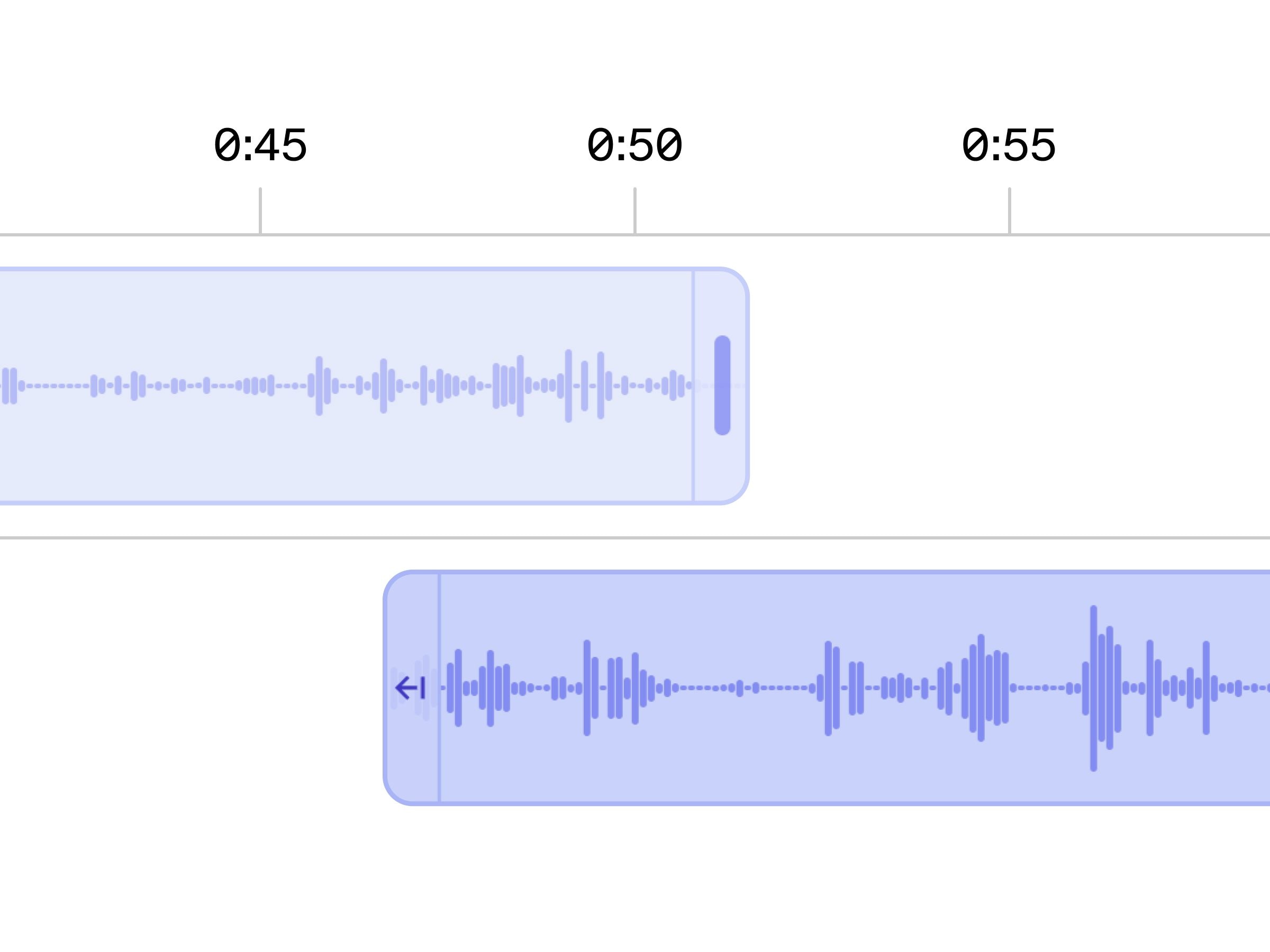

Flexible Zeitleiste

Passen Sie die Position von Audioclips direkt auf der Zeitleiste für eine präzise Übereinstimmung an und optimieren Sie die Synchronisation zwischen gesprochenem Audio und der Aktion auf dem Bildschirm

So synchronisieren Sie Videos automatisch in 29 Sprachen (mit Voice Cloning)

Möchten Sie Millionen neuer Zuschauer erreichen, indem Sie Ihre Videos in verschiedene Sprachen synchronisieren? In diesem Tutorial erfahren Sie Schritt für Schritt, wie Sie Ihre YouTube-Videos (oder andere Videoinhalte) automatisch in 29 Sprachen mit ElevenLabs KI-Synchronisation und Voice Cloning übersetzen.

Sehen Sie, wie Kreative und Unternehmen KI-Spracherzählung nutzen

UNTERNEHMEN

Audioerlebnisse im großen Maßstab beim Publizieren

✓ SLAs auf Unternehmensebene

✓ Dedizierter Support

✓ Vorrangiger Zugang

✓ API-Zugriff

✓ Unbegrenzte Sitzplätze

✓ Mengenrabatte

Vertrauen von führenden Verlags- und Medienunternehmen

Häufig gestellte Fragen

Entdecken Sie unsere Spitzentechnologie

Erstellen Sie individuelle Soundeffekte und Ambient-Audio mit unserem leistungsstarken KI-Soundeffekt-Generator.

Automatisieren Sie Video-Voiceovers, Werbespots, Podcasts und mehr – mit Ihrer eigenen Stimme

Sagen Sie, was Sie möchten, und hören Sie es in einer völlig anderen Stimme – mit voller Kontrolle über die Performance. Erfassen Sie Flüstern, Lachen, Akzente und feine emotionale Nuancen.