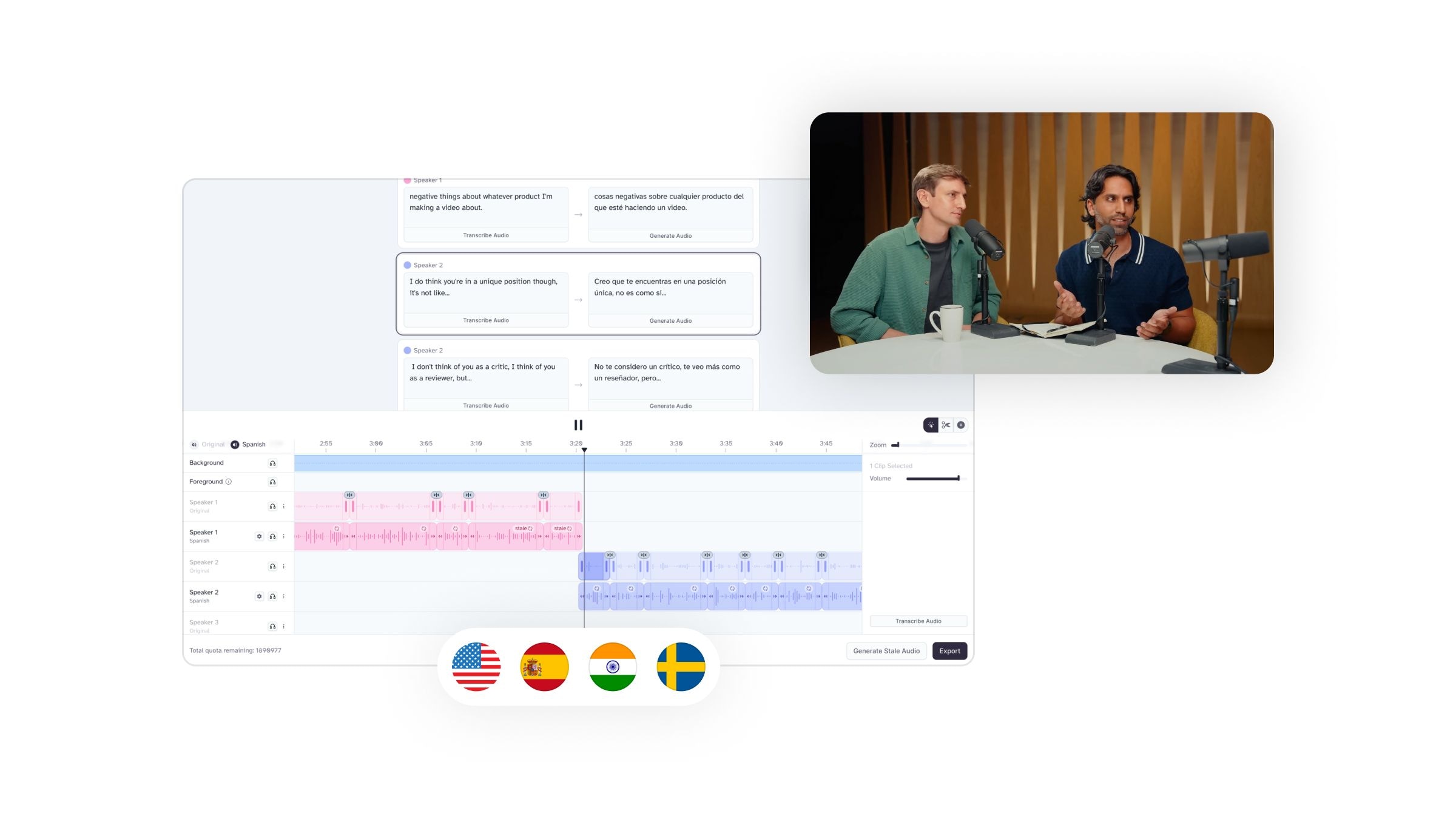

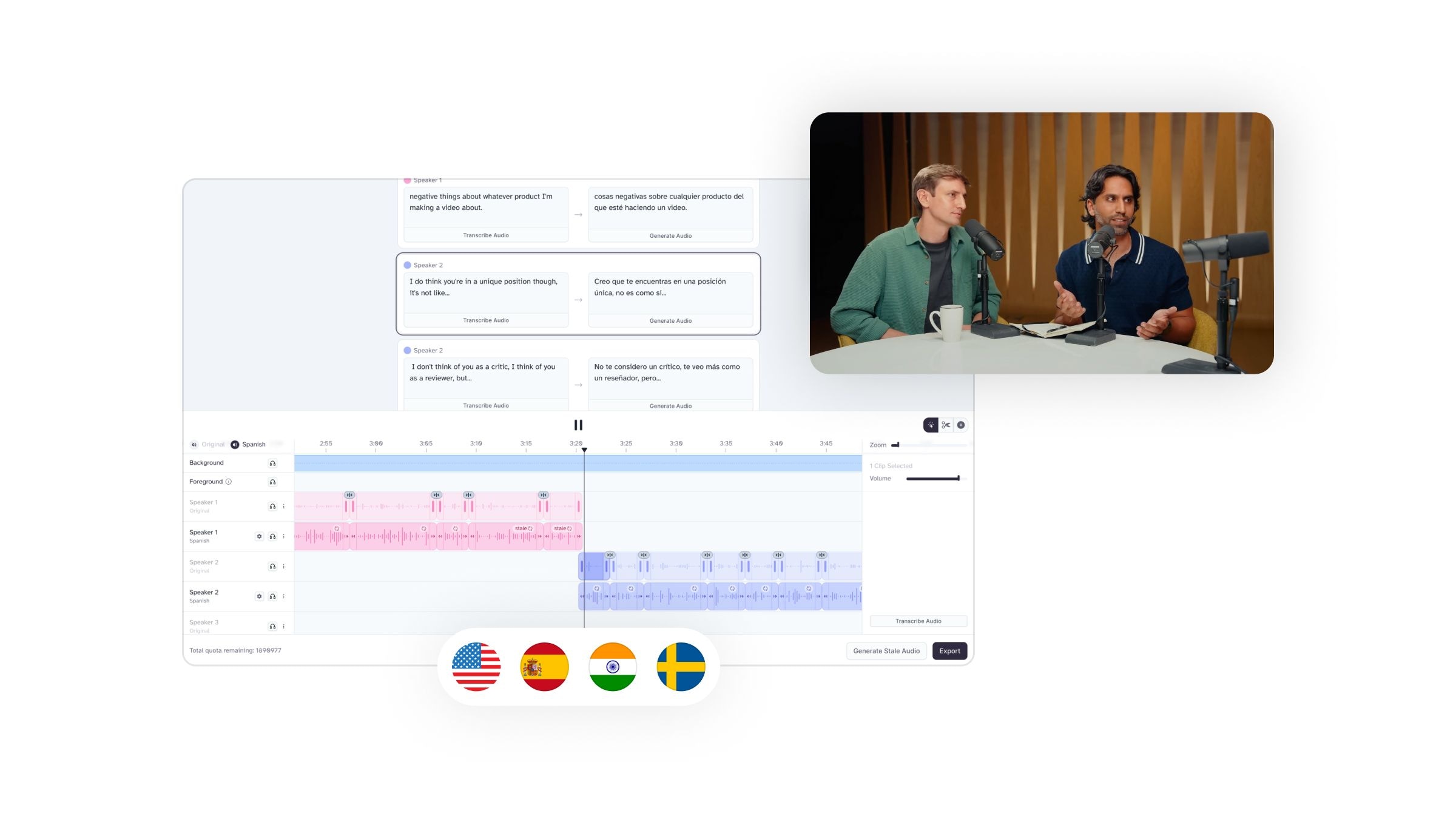

Übersetzen Sie Audio und Video, während Sie die Emotion, das Timing, den Ton und die einzigartigen Merkmale jedes Sprechers bewahren

Entdecken Sie die führenden KI-TTS-Dubbing-Tools von heute.

Durch die Globalisierung der Medien und der Unterhaltung ist die Nachfrage nach qualitativ hochwertigen synchronisierten Inhalten enorm gestiegen. Allerdings sind herkömmliche Synchronisationsverfahren, die auf professionelle Synchronsprecher und Aufnahmestudios angewiesen sind, zeitaufwändig und teuer.

Die Lösung? KI-Synchronisation Technologie.

In diesem Artikel wird erläutert, wie KI-Sprachtechnologie die Synchronisationsbranche verändert, die wichtigsten verfügbaren Tools werden untersucht und praktische Anleitungen für den Einstieg bereitgestellt.

Die Grundlage der KI-gestützten Sprachsynchronisierung sind hochentwickelte neuronale Netzwerke, die anhand umfangreicher Datensätze menschlicher Sprache trainiert wurden. Diese hochentwickelten Systeme analysieren und verstehen nicht nur die gesprochenen Worte, sondern auch die subtilen Nuancen von Tonfall, Rhythmus und Gefühlsausdruck, die Sprache natürlich klingen lassen. Im Gegensatz zu herkömmlichen Text zu Sprache Im Gegensatz zu Software, die früher roboterhafte, monotone Ausgaben produzierte, erzeugen moderne KI-Stimmgeneratoren lebensechte, realistische Stimmen, die die emotionale Wirkung der ursprünglichen Darbietung aufrechterhalten können. Mit Tools wie ElevenLabs können Sie sogar Ihre eigene Stimme synchronisieren.

Die Technologie funktioniert, indem sie die Original-Audiodatei in ihre Einzelteile zerlegt und dabei alles analysiert, von den Phonemen (grundlegende Sprachlaute) bis hin zur Prosodie (Betonungs- und Intonationsmuster). Die KI-Sprachtechnologie rekonstruiert diese Elemente dann in der Zielsprache und behält dabei das Timing und die emotionale Resonanz der Originaldarbietung bei. Dieser Prozess wird durch hochentwickelte Markup-Language-Systeme zur Sprachsynthese ermöglicht, die realistische Sprache erzeugen und gleichzeitig den natürlichen Gesprächsfluss bewahren können.

Was moderne KI-Synchronisierung auszeichnet, ist ihre Fähigkeit, sich an unterschiedliche Sprachstile und Kontexte anzupassen. Unabhängig davon, ob es sich um die Synchronisierung eines Lehrvideos, eines Werbespots oder eines Spielfilms handelt, können diese Systeme ihre Ausgabe an den erforderlichen Ton und Stil anpassen. Die Technologie kann sogar Hintergrundgeräusche und Umgebungsgeräusche in der Originalaufnahme analysieren und so sicherstellen, dass sich die synchronisierte Stimme nahtlos in die vorhandene Audiolandschaft einfügt.

Dieser Grad an Komplexität wird durch Deep-Learning-Algorithmen erreicht, die ihr Verständnis menschlicher Sprachmuster kontinuierlich verbessern. Da diese Systeme mehr Daten verarbeiten, werden sie immer besser darin, natürlich klingende Stimmen zu produzieren, die komplexe Emotionen vermitteln und die Stimmen der Charaktere auch über längere Inhalte hinweg konsistent halten können. Dadurch werden KI-Stimmen zu einer zunehmend attraktiveren Option für Inhaltsersteller, die ein globales Publikum erreichen möchten, ohne Kompromisse bei der Qualität einzugehen.

Die Verwendung eines KI-Sprachgenerators verändert die Herangehensweise von Entwicklern an die Inhaltslokalisierung. Lassen Sie mich die wichtigsten Vorteile erläutern, die KI-Sprachtechnologie zu einer immer beliebteren Wahl für Synchronisationsprojekte machen.

Traditionelle Synchronisation erfordert die Einstellung Synchronsprecher für jede Sprache, zusammen mit Studiozeit und Nachbearbeitungsarbeit. KI-Sprachgeneratoren reduzieren diese Kosten erheblich und sorgen gleichzeitig für eine hohe Sprachqualität in allen Sprachversionen.

Durch KI-gestütztes Synchronisieren können mit nur wenigen Klicks qualitativ hochwertige Stimmen erzeugt werden, wodurch der Zeitaufwand für die Erstellung synchronisierter Inhalte drastisch reduziert wird. Diese Effizienz ermöglicht es den Erstellern von Inhalten, mehrsprachige Versionen gleichzeitig zu veröffentlichen.

Die KI-Sprachtechnologie sorgt für eine perfekte Konsistenz der Charakterstimmen über mehrere Episoden oder Inhaltsteile hinweg und eliminiert die Abweichungen, die im Laufe der Zeit bei menschlichen Synchronsprechern auftreten können.

Im Gegensatz zu herkömmlichen Sprachaufnahmen kann die KI-generierte Synchronisation problemlos geändert und angepasst werden, ohne dass neue Aufnahmesitzungen erforderlich sind. Diese Flexibilität ist besonders wertvoll für Inhalte, die häufige Aktualisierungen erfordern.

Die Landschaft der KI-Sprachtechnologie hat sich rasant weiterentwickelt und mehrere Plattformen bieten anspruchsvolle Lösungen für die Sprachsynchronisierung. Sehen wir uns die führenden Tools an, die die Herangehensweise von Kreativen an die Produktion mehrsprachiger Inhalte verändern.

ElevenLabs ist der beste KI-Sprachgenerator, der derzeit auf dem Markt ist. ElevenLabs repräsentiert den neuesten Stand der KI-Stimmerzeugung und bietet eine außergewöhnliche Stimmqualität, die natürliche Sprachmuster sehr genau nachahmt. Ihre Plattform nutzt fortschrittliche neuronale Netzwerke, um menschenähnliche Stimmen zu erzeugen, die emotionale Authentizität und natürliche Kadenz bewahren, was sie besonders effektiv für professionelle Voiceover- und Synchronisationsprojekte macht.

Vorteile:

Nachteile:

Speechify kombiniert Barrierefreiheit mit ausgefeilter Text-to-Speech-Technologie und ist daher besonders für Bildungsinhalte und E-Learning-Materialien wertvoll. Ihre Plattform bietet natürliche Lesefunktionen mit Unterstützung für mehrere Sprachen und Stimmstile.

Vorteile:

Nachteile:

Murf.AI ist auf die KI-Voiceover-Generierung mit Schwerpunkt auf Videoinhalten spezialisiert. Ihre Plattform integriert die Sprachgenerierung mit Videobearbeitungsfunktionen und ist daher besonders nützlich für Entwickler, die an Multimediaprojekten arbeiten.

Vorteile:

Nachteile:

Invideo AI bietet eine umfassende Lösung, die KI-Avatare mit Sprachgenerierung kombiniert und es Entwicklern ermöglicht, synchronisierte Inhalte mit synchronisierten visuellen Elementen zu erstellen.

Vorteile:

Nachteile:

Mit ElevenLabs ist das Erstellen von synchronisierten Inhalten in professioneller Qualität unkompliziert und effizient. Befolgen Sie diese Schritte, um zu beginnen:

Die Entwicklung der KI-gestützten Text-to-Speech-Technologie hat die Welt der Synchronisation dramatisch verändert und eine Lokalisierung in professioneller Qualität zugänglicher und effizienter gemacht als je zuvor. Mit den besten KI-Stimmgeneratoren (wie ElevenLabs) an der Spitze können Kreative jetzt synchronisierte Inhalte produzieren, die die emotionale Wirkung und den natürlichen Fluss der Originaldarbietung bewahren und gleichzeitig Produktionszeit und -kosten deutlich reduzieren.

Sind Sie bereit, Ihren Synchronisations-Workflow zu revolutionieren? Beginnen Sie Ihre Reise mit ElevenLabs noch heute und erleben Sie die Zukunft der Sprachgenerierungstechnologie.

Übersetzen Sie Audio und Video, während Sie die Emotion, das Timing, den Ton und die einzigartigen Merkmale jedes Sprechers bewahren

Inhalte aus allen Ecken der Welt sind jetzt in greifbarer Nähe

KI und maschinelles Lernen haben die Grundlage für die Entwicklung synthetischer Sprache geschaffen, die menschliche Sprache genau nachahmt.

Bereitgestellt von ElevenLabs Agenten