ElevenLabs की साझेदारी जनरेटिव AI फॉर गुड के साथ संयुक्त राष्ट्र में शुरू हुई

- लेखक

- Gabi Leibowitz

- प्रकाशित

सुनेंइस आर्टिकल को सुनें

यह कार्यक्रम Shiran Mlamdovsky-Somech और Tatiana Kotlyarenko द्वारा होस्ट किया गया और UNITAR व Kigali Genocide Memorial के साथ मिलकर आयोजित किया गया। इसमें नीति, तकनीक और मानवाधिकार के क्षेत्र के लीडर्स ने हिस्सा लिया और चर्चा की कि एथिकल AI शांति निर्माण और पीड़ितों की सुरक्षा में कैसे मदद कर सकता है।

हमारा उद्देश्य है कि संघर्ष से जुड़ी यौन हिंसा के पीड़ित अपनी गवाही सुरक्षित रूप से साझा कर सकें, जिसमें अनाम AI-जनित आवाज़ों का इस्तेमाल हो, जो भाव, स्पष्टता और भावना को बनाए रखते हुए पहचान का जोखिम खत्म करती हैं। इम्पैक्ट प्रोग्राम के तहत, हमने इस पहल के लिए ElevenLabs वॉइस टेक्नोलॉजी मुफ्त में उपलब्ध कराई।

"Hearing Their Voices" का एक क्लिप देखें

यह काम क्यों ज़रूरी है

संघर्ष से जुड़ी यौन हिंसा सिर्फ व्यक्तिगत त्रासदी नहीं, बल्कि शांति, स्थिरता और न्याय के लिए एक संरचनात्मक खतरा है। पीड़ित अक्सर कलंक, डर या सीधे खतरे के कारण चुप रहते हैं। जब गवाही साझा नहीं हो पाती, तो अंतरराष्ट्रीय समुदाय को वह अहम सबूत नहीं मिल पाता, जो रोकथाम, जवाबदेही और दीर्घकालिक पुनर्वास के लिए ज़रूरी है।

जिनेवा में होने वाला यह कार्यक्रम इस चुनौती को उजागर करता है। हर साल, महिलाओं के खिलाफ हिंसा उन्मूलन के अंतरराष्ट्रीय दिवस पर समन्वित वैश्विक कार्रवाई की आवश्यकता पर जोर दिया जाता है। आज के सत्र में AI, CRSV, और शांति निर्माण के संगम पर जोखिमों और अवसरों की जांच की गई। इस व्यापक संदर्भ में, उनकी आवाज़ सुनना दिखाता है कि एथिकल AI का इस्तेमाल दस्तावेज़ीकरण मजबूत करने और पीड़ितों की कहानियों को आगे लाने में कैसे किया जा सकता है।

ElevenLabs इम्पैक्ट प्रोग्राम की भूमिका

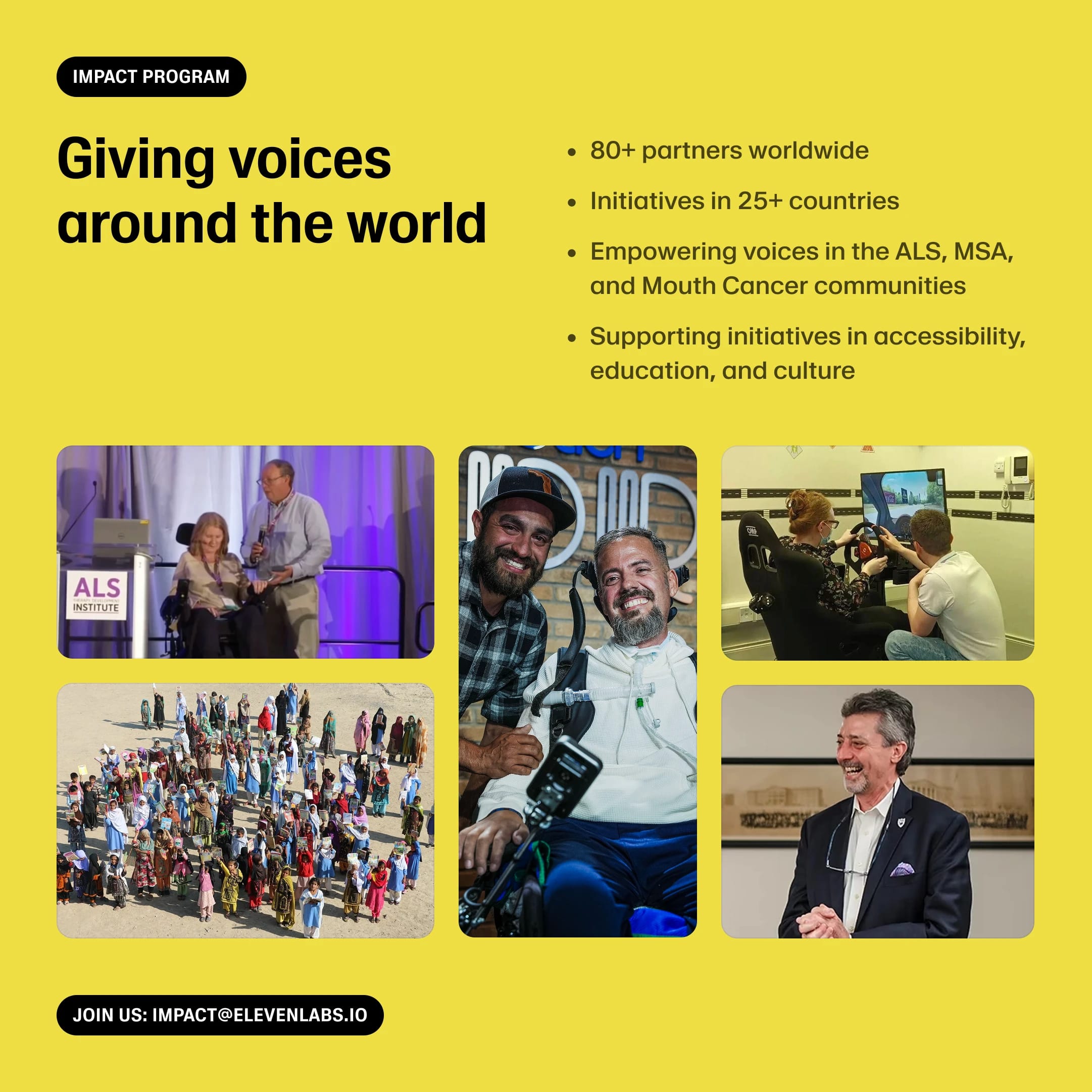

इस पहल में हमारा योगदान ElevenLabs इम्पैक्ट प्रोग्राम के मिशन से जुड़ा है, जो हेल्थकेयर, शिक्षा और संस्कृति जैसे क्षेत्रों में जनहित के लिए काम करने वाले गैर-लाभकारी संगठनों को सपोर्ट करता है। हम इन संस्थाओं को संवाद बेहतर करने, पहचान सुरक्षित रखने और ज़रूरी जानकारी को और सुलभ बनाने के लिए संसाधन उपलब्ध कराते हैं।

Generative AI for Good के लिए, इसका मतलब है एक सुरक्षित और पीड़ित-केंद्रित कहानी कहने की प्रक्रिया बनाना। फोकस सुरक्षा पर है: गवाही सुनी जा सके, लेकिन किसी को और नुकसान न पहुंचे। यह तकनीक अर्थ को सुरक्षित रखते हुए पहचान छुपाने के लिए बनाई गई है, ताकि कहानियाँ असली रहें और पहचान सुरक्षित।

आगे की राह

जैसे-जैसे वैश्विक संस्थाएँ मानवाधिकार, दस्तावेज़ीकरण और शांति निर्माण में AI के इस्तेमाल पर विचार कर रही हैं, यह काम एथिकल प्रैक्टिस पर आधारित एक मॉडल पेश करता है। आज जिनेवा में शुरू हुई यह पहल दिखाती है कि जिम्मेदार AI कैसे पीड़ितों की मदद कर सकता है, नीति निर्माण में योगदान दे सकता है और दीर्घकालिक स्थिरता ला सकता है।

आप इसके बारे में और जान सकते हैं उनकी आवाज़ सुनना और पूरा प्रोजेक्ट यहाँ देख सकते हैं https://theirvoices.ai/.

-1.webp&w=3840&q=80)