Tester les agents IA conversationnels

- Rédigé par

- Anna Neely

- Publié

- Dernière mise à jour

ÉcouterÉcouter cet article

Lorsque les

Ces questions ont façonné notre travail sur El, notre assistant de documentation propulsé par IA conversationnelle. Au fur et à mesure qu'El évoluait, nous avons construit un système de surveillance, évaluer, et tester les agents, basé sur des critères d'évaluation et des simulations de conversation.

Poser les bases : Critères d'évaluation fiables

Améliorer un agent commence par comprendre comment il se comporte sur le terrain. Cela signifiait affiner nos critères d'évaluation et s'assurer qu'ils étaient suffisamment précis et fiables pour surveiller la performance de l'agent. Nous définissons une conversation échouée comme celle où l'agent donne des informations incorrectes ou n'aide pas l'utilisateur à atteindre son objectif.

Nous avons développé les critères d'évaluation suivants :

- Interaction: s'agit-il d'une conversation valide, l'utilisateur a-t-il posé des questions pertinentes, la conversation avait-elle du sens ?

- Interaction positive: l'utilisateur est-il parti satisfait, ou était-il confus ou frustré ?

- Comprendre la cause profonde: l'agent a-t-il correctement identifié le problème sous-jacent de l'utilisateur ?

- Résoudre la demande de l'utilisateur: l'agent a-t-il résolu le problème de l'utilisateur ou fourni une méthode de support alternative ?

- Hallucination: l'agent a-t-il inventé des informations qui ne sont pas dans la base de connaissances ?

Si l'Interaction échoue, la conversation elle-même n'est pas valide. Si d'autres critères échouent, nous enquêtons davantage. L'enquête guide comment nous améliorons l'agent. Parfois, il s'agit de peaufiner l'utilisation des outils ou le timing. D'autres fois, il s'agit d'ajouter des garde-fous pour éviter des actions non prises en charge.

Itérer avec confiance : API de simulation de conversation

Une fois que nous avons identifié ce qu'il faut améliorer, l'étape suivante est le test. C'est là que notre API de simulation de conversation intervient. Il simule des scénarios utilisateur réalistes - à la fois de bout en bout et dans des segments ciblés - et évalue automatiquement les résultats en utilisant les mêmes critères que nous appliquons en production. Il prend en charge la simulation d'outils et l'évaluation personnalisée, ce qui le rend suffisamment flexible pour tester des comportements spécifiques.

Nous utilisons deux approches :

- Simulations complètes : Testez des conversations entières du début à la fin.

- Simulations partielles : Commencez en milieu de conversation pour valider des points de décision ou des sous-flux. C'est notre méthode privilégiée pour les tests unitaires, permettant une itération rapide et un débogage ciblé.

Des scénarios clairs et ciblés nous permettent de contrôler ce sur quoi le LLM est testé, garantissant une couverture pour les cas limites, l'utilisation des outils et la logique de repli.

Automatiser pour l'échelle : Intégrer les tests dans le CI/CD

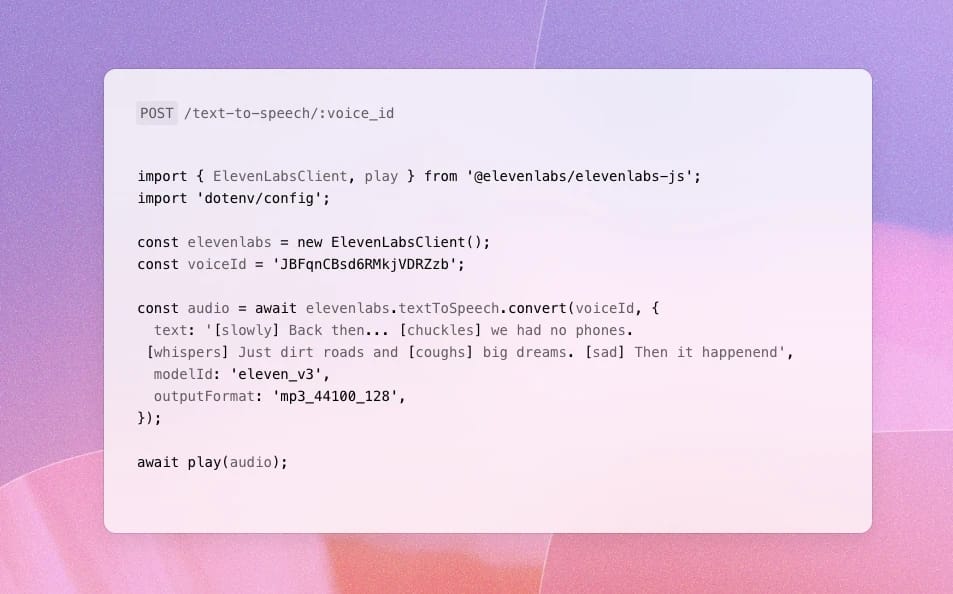

La dernière pièce est l'automatisation. Nous avons utilisé les API ouvertes d'ElevenLabs pour nous connecter à notre flux GitHub DevOps en intégrant l'évaluation et la simulation dans notre pipeline CI/CD. Chaque mise à jour est automatiquement testée avant le déploiement. Cela prévient les régressions et nous donne un retour rapide sur la performance en conditions réelles.

Résultats : Un El plus fort et plus intelligent

Ce processus a transformé notre façon de construire et de maintenir El. Nous avons créé un cycle de retour d'information qui relie l'utilisation réelle à une évaluation structurée, des tests ciblés et une validation automatisée, nous permettant d'apporter des améliorations plus rapidement et avec plus de confiance.

Et c'est un cadre que nous pouvons désormais appliquer à tout

.webp&w=3840&q=80)