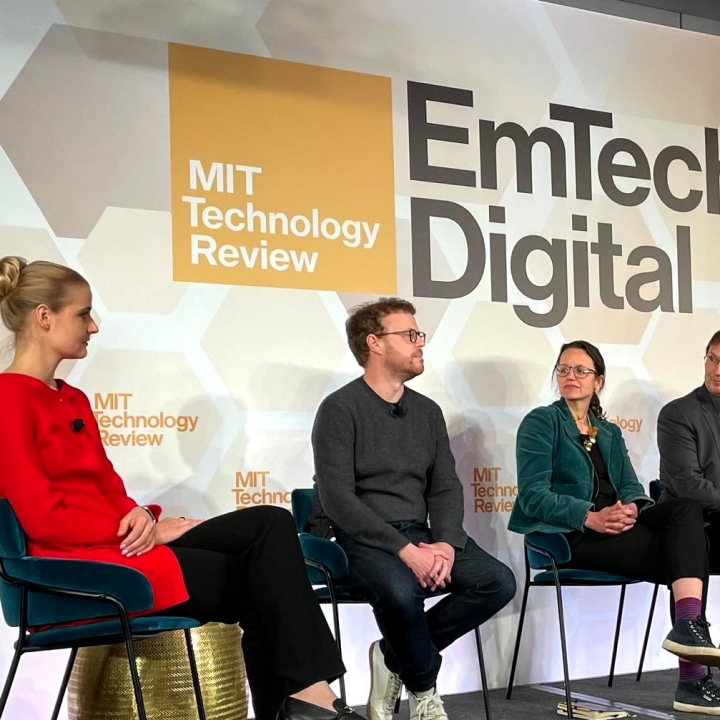

Faire progresser la sécurité de l'IA avec Reality Defender

Comment notre collaboration soutient une meilleure détection des voix générées par l'IA

Présentation de Eleven v3 Alpha

Essayez v3

Comment notre collaboration soutient une meilleure détection des voix générées par l'IA

L’année 2024 dans son ensemble constituera une période électorale charnière dans des pays du monde entier. Et nous avons pris des mesures concrètes visant à empêcher l'utilisation abusive de nos outils.

ElevenLabs est fier de soutenir deux textes législatifs promouvant une IA responsable.

Reality Defender dope ses systèmes de détection d'IA en exploitant les données et les informations d'ElevenLabs sur l'IA audio.

Améliorer la sécurité de l'IA en mettant l'accent sur la provenance, la traçabilité et la modération du contenu

Assurer l’intégrité des élections grâce à un développement responsable de l’IA

Notre priorité consiste à garantir que nos systèmes sont développés, déployés et utilisés en toute sécurité.

Garantir une protection contre les abus potentiels de l'IA audio

Améliorer la transparence sur un contenu généré par l'IA