Optymalizacja syntezy mowy dla interakcji z AI w czasie rzeczywistym

- Opublikowano

- Ostatnia aktualizacja

PosłuchajPosłuchaj tego artykułu

Podsumowanie

- Synteza mowy to proces zamiany tekstu na mowę przypominającą ludzką.

- Optymalizowana synteza mowy zapewnia naturalne tempo, emocjonalne brzmienie i szybkie odpowiedzi podczas interakcji.

- Popularne zastosowania syntezy mowy to asystenci wirtualni, gry, opieka zdrowotna i edukacja, zmieniając sposób, w jaki ludzie korzystają z AI.

- Zaawansowane narzędzia Text to Speech, jak ElevenLabs, rozwiązują typowe wyzwania w syntezie mowy, takie jak utrzymanie naturalnego przepływu i równowaga między szybkością a jakością.

Przegląd

Conversational AI staje się coraz bardziej naturalne, a postępy w syntezie mowy są kluczowe dla tych ulepszeń. Optymalizowane wyjście mowy pozwala agentom AI odpowiadać w sposób przypominający ludzki w czasie rzeczywistym, zmieniając sposób, w jaki wchodzimy w interakcje z maszynami i ich zastosowaniami.

Conversational AI zaczyna brzmieć prawdziwie

Czy kiedykolwiek rozmawiałeś z wirtualnym asystentem i doświadczyłeś efektu doliny niesamowitości? Jakby coś było nie tak? Cóż, to nic dziwnego. Robotyczny, monotoniczny głos może sprawić, że nawet najinteligentniejsze AI wydaje się bezosobowe i frustrujące.

Wkracza optymalizowana synteza mowy; sekret, by AI brzmiało naturalnie, angażująco i, co najważniejsze, jak żywe. Dzięki dopracowaniu, jak tekst jest zamieniany na mowę, tworzymy AI, które nie tylko dostarcza informacji, ale robi to w sposób przypominający rozmowę z prawdziwą osobą.

Zobaczmy, jak synteza mowy napędza rozwój Conversational AI i dlaczego jej optymalizacja jest kluczem do tworzenia inteligentniejszych, bardziej naturalnych interakcji.ewolucję Conversational AI i dlaczego jej optymalizacja jest kluczem do tworzenia inteligentniejszych, bardziej zrozumiałych interakcji.

Czym jest synteza mowy?

Synteza mowy, znana również jako text to speech, to technologia, która zamienia tekst pisany na mowę. Umożliwia AI odpowiadanie dźwiękowe podczas rozmowy.

W sercu syntezy mowy znajdują się silniki text-to-speech (TTS). Te silniki używają zaawansowanych algorytmów do analizy tekstu, określania odpowiedniego tonu i generowania wyraźnej, naturalnie brzmiącej mowy. W przeciwieństwie do nagrań audio, synteza mowy działa dynamicznie, produkując odpowiedzi w czasie rzeczywistym na podstawie danych wejściowych użytkownika.

Synteza mowy to powiew świeżości dla Conversational AI. Sprawia, że interakcje są bardziej dostępne, angażujące i inkluzywne, zapewniając użytkownikom poczucie zrozumienia i połączenia.

Korzyści z optymalizacji syntezy mowy

Podczas gdy wcześniejsze narzędzia syntezy mowy generowały robotyczny i monotoniczny dźwięk, zaawansowane systemy TTS potrafią odpowiadać głosami przypominającymi ludzkie w ułamku czasu.robotyczne i monotoniczne wyjście, zaawansowane systemy TTS mogą odpowiadać głosami przypominającymi ludzkie w ułamku czasu.

Te postępy pokazują znaczenie ciągłej optymalizacji syntezy mowy, prowadząc do wielu korzyści:

Naturalne tempo

Czy zauważyłeś, że prawdziwe rozmowy zawierają pauzy, akcenty i zróżnicowane tony? Optymalizowana synteza mowy naśladuje te niuanse, sprawiając, że odpowiedzi AI brzmią naturalnie, a nie robotycznie.

Emocjonalne połączenie

Ton i modulacja są podstawą ludzkich rozmów. Optymalizowana synteza pozwala AI wyrażać emocje jak ekscytacja, empatia czy pilność, tworząc głębsze połączenie z użytkownikami.

Odpowiedzi w czasie rzeczywistym

Czas jest kluczowy. Opóźniony agent AI może być frustrujący, zwłaszcza gdy się spieszysz. Optymalizowane TTS zapewnia, że synteza mowy nadąża za danymi wejściowymi użytkownika, dostarczając szybkie odpowiedzi bez kompromisów w jakości interakcji.

5 sposobów, jak optymalizowana synteza mowy poprawia interakcje AI

Postępy w syntezie mowy niewątpliwie doprowadziły do znaczących ulepszeń w wynikach Conversational AI.

Chociaż osiągnięcie pełnej autentyczności wymaga jeszcze pracy, optymalizowana synteza mowy już przyczyniła się do rozwoju wielu innowacji w różnych branżach:

1. Asystenci wirtualni jak żywi

Dzięki optymalizowanej syntezie mowy, asystenci głosowi jak Siri i Alexa stają się coraz bardziej ludzcy. Prowadzą naturalne rozmowy, dostarczają natychmiastowe odpowiedzi i nawet dostosowują ton w zależności od kontekstu.

2. Ulepszone doświadczenia w grach

W grach wideo, postacie z AI z realistycznymi dialogami ożywiają historie. Synteza mowy dostosowuje ich odpowiedzi na podstawie działań gracza, czyniąc rozgrywkę bardziej wciągającą i interaktywną.

3. Interaktywna edukacja

AI nauczyciele dostarczają lekcje w jasnym, angażującym głosie, odpowiadając na pytania w czasie rzeczywistym. Niezależnie czy pomagają w zadaniach matematycznych, czy uczą nowego języka, optymalizowana synteza mowy sprawia, że e-learning jest bardziej autentyczny i dynamiczny.

4. Wsparcie w opiece zdrowotnej

Synteza mowy umożliwia asystentom AI prowadzenie pacjentów przez rutynowe zadania jak przyjmowanie leków, śledzenie objawów czy umawianie wizyt. Kojący, empatyczny ton zapewnia, że użytkownicy czują się zaopiekowani i wspierani.

5. Boty obsługi klienta

Technologia TTS zasila boty obsługi klienta, które odpowiadają na zapytania, poprawiając ogólne doświadczenie. Wyraźna, naturalna mowa zapewnia, że użytkownicy czują się wysłuchani i zrozumiani, nawet bez udziału człowieka.

Powszechne zastosowania Conversational AI zasilane syntezą mowy

Oprócz wymienionych przykładów, optymalizowana synteza mowy pozwoliła na wprowadzenie narzędzi Conversational AI do naszego codziennego życia. Choć nie zawsze zauważamy jej obecność, zaawansowana technologia syntezy mowy stoi za wieloma realistycznymi interakcjami, które mamy z asystentami AI.

Urządzenia inteligentnego domu: Wirtualni asystenci jak Google Assistant używają syntezy mowy do dostarczania aktualizacji w czasie rzeczywistym, kontrolowania urządzeń IoT i odpowiadania na polecenia użytkownika naturalnym głosem.

Aplikacje do nauki języków: Aplikacje jak Duolingo używają TTS do modelowania poprawnej wymowy i prowadzenia użytkowników przez praktykę konwersacyjną, pomagając im nabrać pewności w nowych językach.

Platformy rozrywkowe: Audiobooki i aplikacje do interaktywnego opowiadania historii wykorzystują optymalizowane TTS do narracji w angażujących, żywych głosach, które dostosowują się do tonu i kontekstu narracji.

Kioski detaliczne: W sklepach, kioski zasilane AI używają syntezy mowy do prowadzenia klientów, odpowiadania na pytania o produkty i udzielania spersonalizowanych rekomendacji, poprawiając doświadczenie zakupowe.

Węzły transportowe: Cyfrowi asystenci na lotniskach i stacjach kolejowych dostarczają ogłoszenia w czasie rzeczywistym i pomoc w orientacji w jasnych, łatwych do zrozumienia głosach.

Platformy telemedyczne: Asystenci AI w aplikacjach telemedycznych używają syntezy mowy do wyjaśniania instrukcji medycznych, umawiania wizyt kontrolnych i udzielania wskazówek zdrowotnych dźwiękowo, poprawiając dostępność i opiekę.

Jak optymalizować wyjście mowy z ElevenLabs

Niezależnie czy chcesz zoptymalizować istniejącego agenta

Oto jak zacząć:

1. Wybierz lub stwórz głos

Możesz zacząć od wyboru narratora z biblioteki ElevenLabs pełnej żywych głosów lub zaprojektować własny głos, aby pasował do kontekstu twojej marki lub projektu.

2. Dopracuj dostarczanie

Dostosuj ton, tempo i modulację, aby pasowały do kontekstu twojej aplikacji. Niezależnie czy tworzysz asystenta zdrowotnego, wirtualnego nauczyciela czy postać z gry wideo, możliwości personalizacji są nieograniczone.

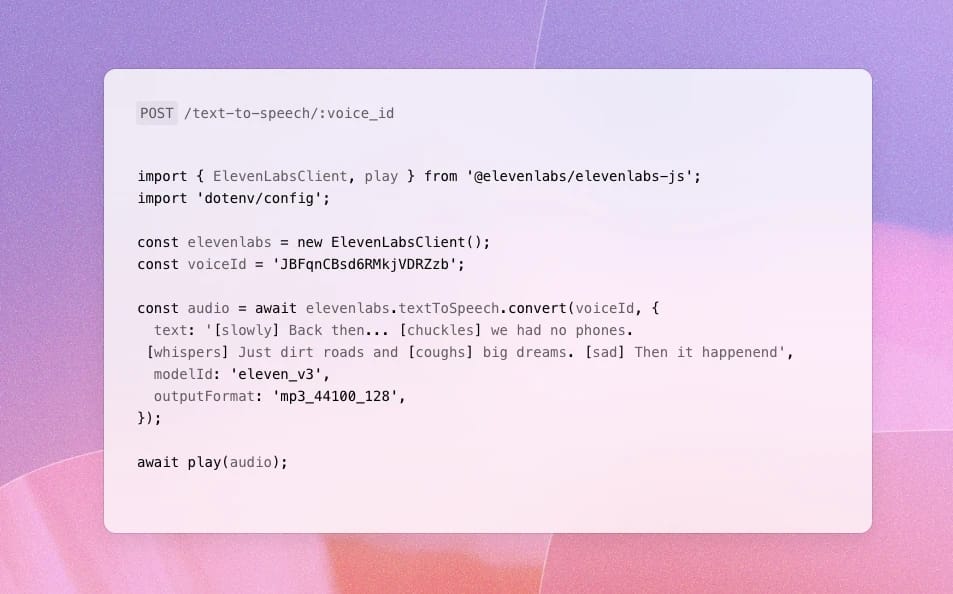

3. Zintegruj z systemem AI

Gdy już wybierzesz i dostosujesz swój głos, zintegruj API ElevenLabs TTS z platformą Conversational AI, aby uzyskać dynamiczną syntezę mowy w czasie rzeczywistym.

4. Testuj i dopracuj

Przeprowadzaj scenariusze, aby ocenić, jak twoje AI brzmi w rzeczywistych interakcjach. Wykorzystaj opinie, aby dostosować ustawienia głosu i zapewnić optymalną jakość odpowiedzi.

5. Uruchom i monitoruj

Wdrażaj swoje AI zasilane TTS i obserwuj jego wydajność. Ciągłe monitorowanie pomaga utrzymać jakość i spełniać oczekiwania użytkowników.

Wyzwania w optymalizacji syntezy mowy

Chociaż optymalizacja syntezy mowy doprowadziła do wielu cennych innowacji, wciąż jest wiele do zrobienia. Najważniejsze wyzwania, z którymi mierzą się deweloperzy, to:

Równoważenie szybkości i jakości: Osiągnięcie szybkich odpowiedzi w czasie rzeczywistym bez utraty jakości wyjścia to ciągłe wyzwanie. Chociaż zaawansowane narzędzia TTS jak ElevenLabs radzą sobie z tym dzięki potężnym możliwościom przetwarzania, wciąż jest miejsce na poprawę.

Zapewnienie emocjonalnej autentyczności: Sprawienie, by głosy AI brzmiały empatycznie lub entuzjastycznie, może być trudne. Ciągłe ulepszenia w TTS pomagają AI wyrażać bardziej autentyczne emocje, ale pełne odwzorowanie ludzkiej mowy to wciąż praca w toku.

Rozwijanie możliwości wielojęzycznych: Dostosowanie optymalizowanej syntezy mowy do wielu języków wymaga zrozumienia kulturowych niuansów i wymowy. Zaawansowane narzędzia jak ElevenLabs oferują wsparcie wielojęzyczne, aby sprostać tym potrzebom, ale wciąż mamy długą drogę do pokrycia wszystkich języków.

Końcowe przemyślenia

Optymalizowana synteza mowy niewątpliwie poprawia wyniki Conversational AI, czyniąc je bardziej ludzkimi, angażującymi i dostępnymi. Od urządzeń inteligentnego domu po gry, edukację i opiekę zdrowotną, ta technologia zmienia sposób, w jaki wchodzimy w interakcje z AI w czasie rzeczywistym.

Chociaż wciąż jest trochę pracy do zrobienia w kwestii jakości, autentyczności i możliwości wielojęzycznych, zaawansowane narzędzia TTS jak ElevenLabs oferują deweloperom skuteczną drogę na skróty do optymalizacji ich agentów

Gotowy, by zoptymalizować wyjście mowy dla swojego agenta?